使用 Edge Impulse 进行一站式模型训练

概述

在本教程中,我们将教您如何使用 Edge Impulse 为您的特定应用训练自己的 AI 模型,然后轻松将其部署到 SenseCAP A1101 - LoRaWAN 视觉 AI 传感器上。让我们开始吧!

**什么是 Edge Impulse?**Edge Impulse 是面向企业团队的边缘 AI 平台,用于在任何边缘设备上构建优化模型。通过先进的 AI 传感器功能,更快地交付价值并实现产品创新。

硬件准备

Seeed SenseCAP A1101 - LoRaWAN 视觉 AI 传感器是专为开发者设计的图像识别 AI 传感器。SenseCAP A1101 - LoRaWAN 视觉 AI 传感器结合了 TinyML AI 技术和 LoRaWAN 长距离传输,为室内外使用提供了低功耗、高性能的 AI 设备解决方案。

该传感器采用海思的高性能、低功耗 AI 视觉解决方案,支持 Google TensorFlow Lite 框架和多个 TinyML AI 平台。

它完全支持 Edge Impulse,这意味着您可以从摄像头采样原始数据、构建模型,并直接从工作室将训练好的机器学习模型部署到模块上,无需任何编程。SenseCAP - 视觉 AI 模块可直接从 Seeed Studio Bazaar 购买。

- SenseCAP A1101 - LoRaWAN 视觉 AI 传感器

- USB Type-C 数据线

- 具有互联网连接的 Windows/ Linux/ Mac

软件准备

要在 Edge Impulse 中设置此 A1101,您需要安装以下软件:

- Edge Impulse CLI。

- 在 Linux 上:

- GNU Screen:例如通过

sudo apt install screen安装。

- GNU Screen:例如通过

- 下载最新的 Bouffalo Lab Dev Cube

安装 Edge Impulse CLI 时遇到问题? 请参阅安装和故障排除指南。

连接到 Edge Impulse

安装好所有软件后,现在是时候将 A1101 连接到 Edge Impulse 了。

如果您在 2023年3月30日 之后购买了设备,则无需更新 EI 固件,请直接跳转到 步骤3 设置密钥。请注意,更新 EI 固件将覆盖默认模型。

步骤 1. 更新 BL702 芯片固件

BL702 是 USB-UART 芯片,它实现了 PC 和海思芯片之间的通信。您需要更新此固件以使 Edge Impulse 固件正常工作。

-

从这里获取最新的引导加载程序固件:tinyuf2-sensecap_vision_ai_xxx.bin。

-

在按住 A1101 上的 Boot 按钮的同时,通过 USB Type-C 数据线将 A1101 连接到 PC。

- 打开之前安装的 Bouffalo Lab Dev Cube 软件,选择 BL702/704/706,然后点击 Finish。

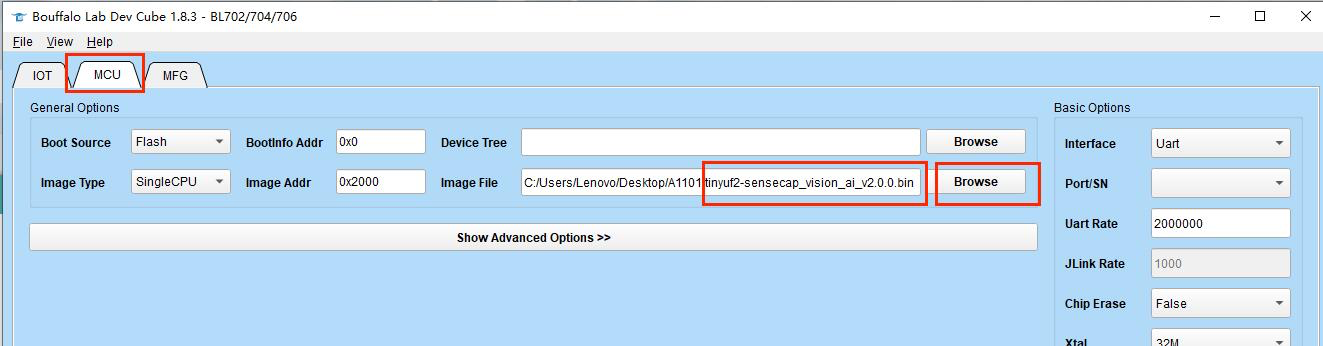

- 转到 MCU 选项卡。在 Image file 下,点击 Browse 并选择您刚刚下载的固件。

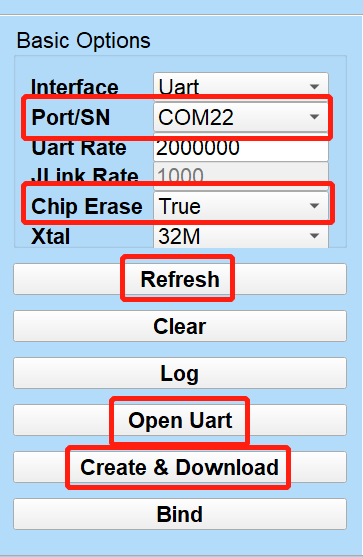

- 点击 Refresh,选择与连接的 A1101 相关的 Port,将 Chip Erase 设置为 True,点击 Open UART,点击 Create & Download 并等待过程完成。

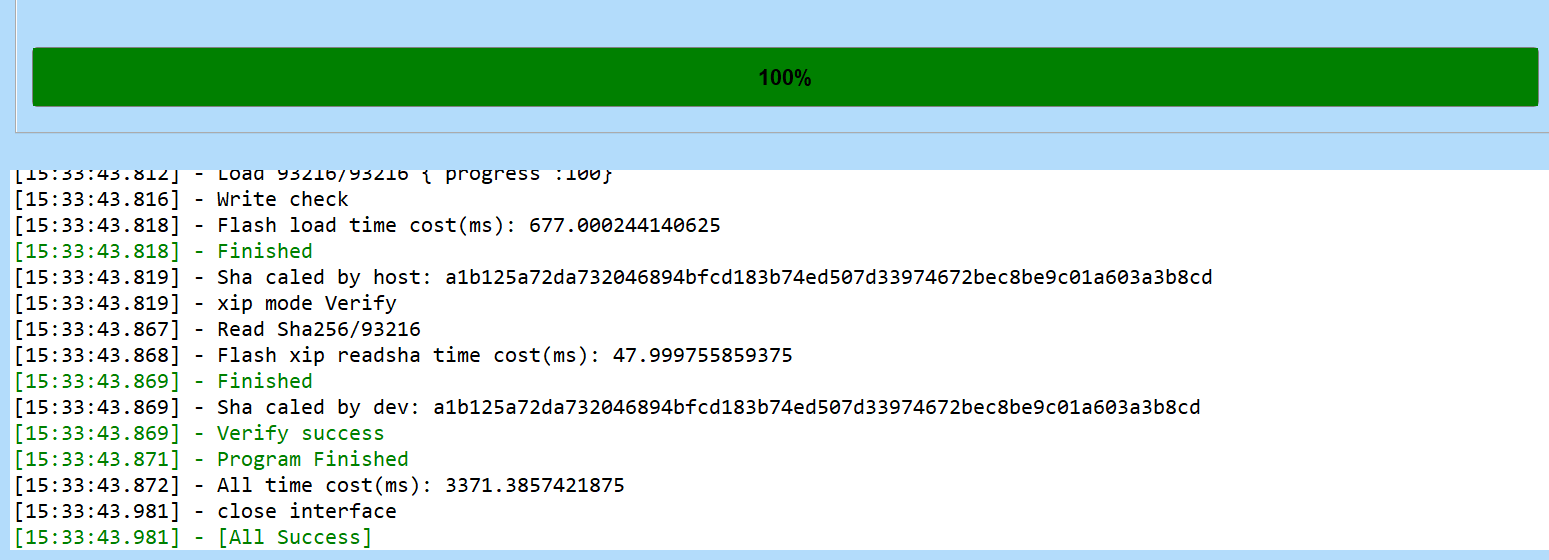

如果一切顺利,您将看到输出显示为 All Success。

如果刷写出现错误,请尝试多次点击 Create & Download,直到看到 All Success 消息。

步骤 2. 更新 Edge Impulse 固件

A1101 尚未配备正确的 Edge Impulse 固件。要更新固件:

-

下载最新的 Edge Impulse 固件并解压以获得 firmware.uf2 文件。

-

通过 USB Type-C 数据线再次将 A1101 连接到 PC,并双击 A1101 上的 Boot 按钮进入大容量存储模式。

-

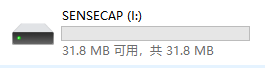

之后您将在文件资源管理器中看到一个新的存储驱动器显示为 SENSECAP。将 firmware.uf2 文件拖放到 SENSECAP 驱动器中。

复制完成后,SENSECAP 驱动器将消失。这是我们检查复制是否成功的方法。

步骤 3. 设置密钥

从命令提示符或终端运行:

edge-impulse-daemon

这将启动一个向导,要求您登录并选择一个 Edge Impulse 项目。如果您想切换项目,请使用 --clean 参数运行该命令。

或者,最新版本的 Google Chrome 和 Microsoft Edge 可以直接从您的 A1101 收集数据,无需 Edge Impulse CLI。更多信息请参见这篇博客文章。

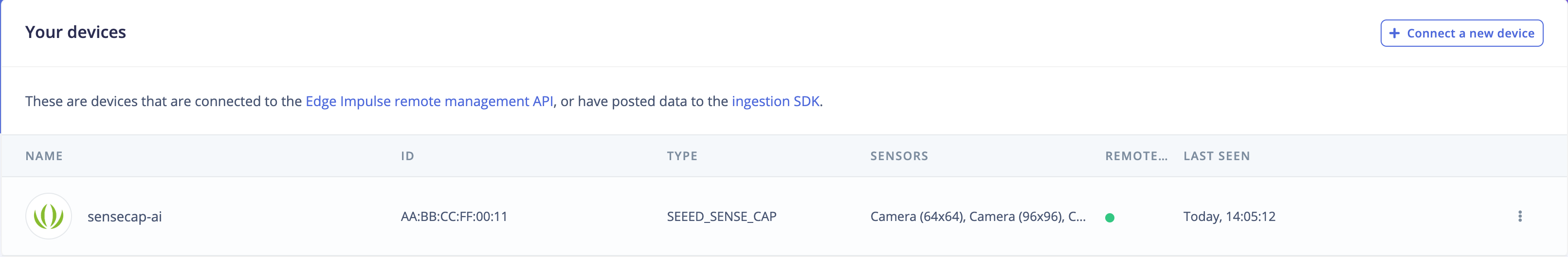

步骤 4. 验证设备已连接

就是这样!您的设备现在已连接到 Edge Impulse。要验证这一点,请转到您的 Edge Impulse 项目,然后点击设备。设备将在此处列出。

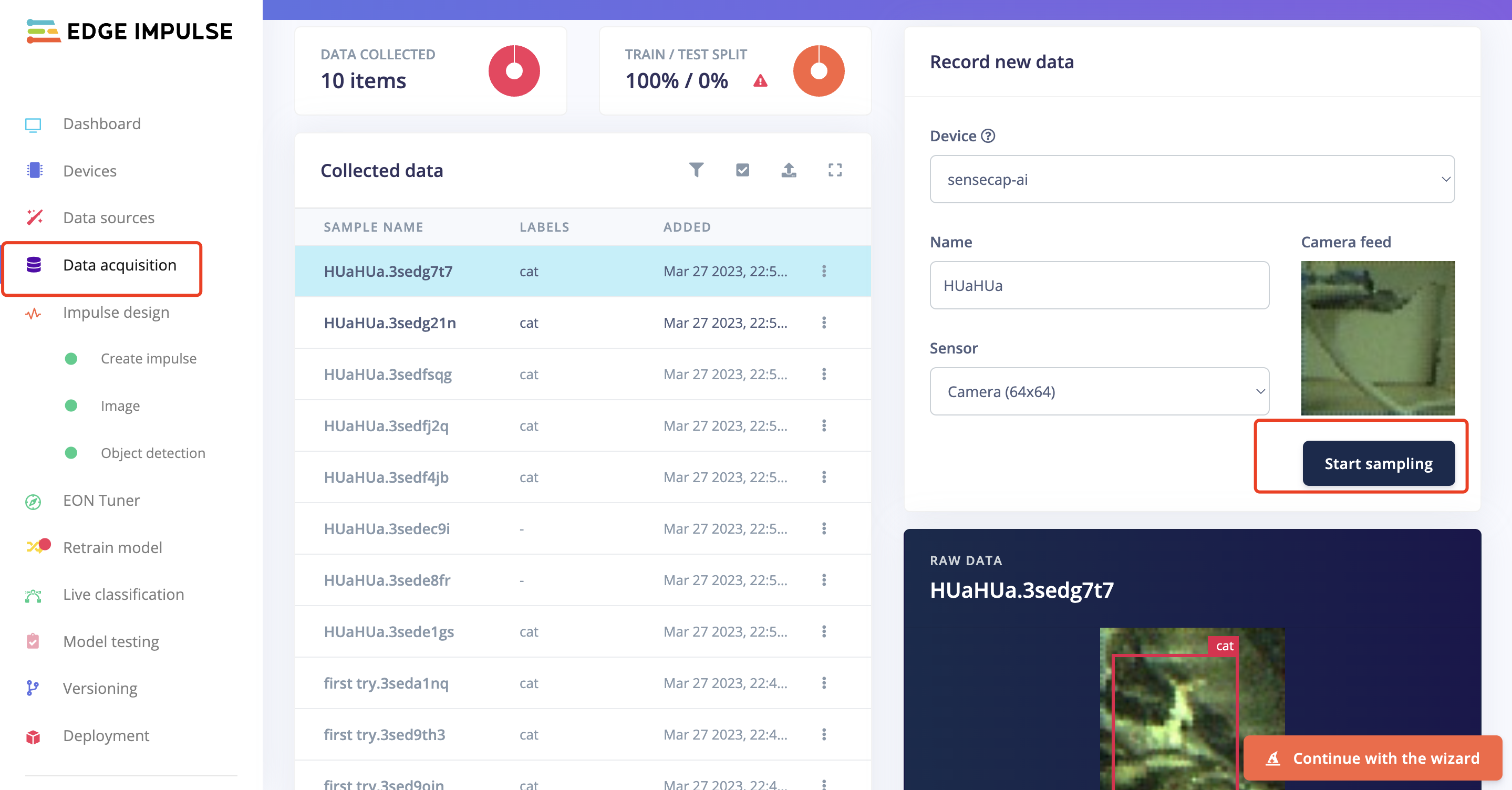

从 A1101 - Vision AI 收集数据

完成所有设置后,您现在可以通过以下教程构建并运行您的第一个机器学习模型:

可以直接从工作室捕获板载摄像头的帧:

最后,一旦模型训练完成,就可以轻松部署到 A1101 – Vision AI 模块开始推理!

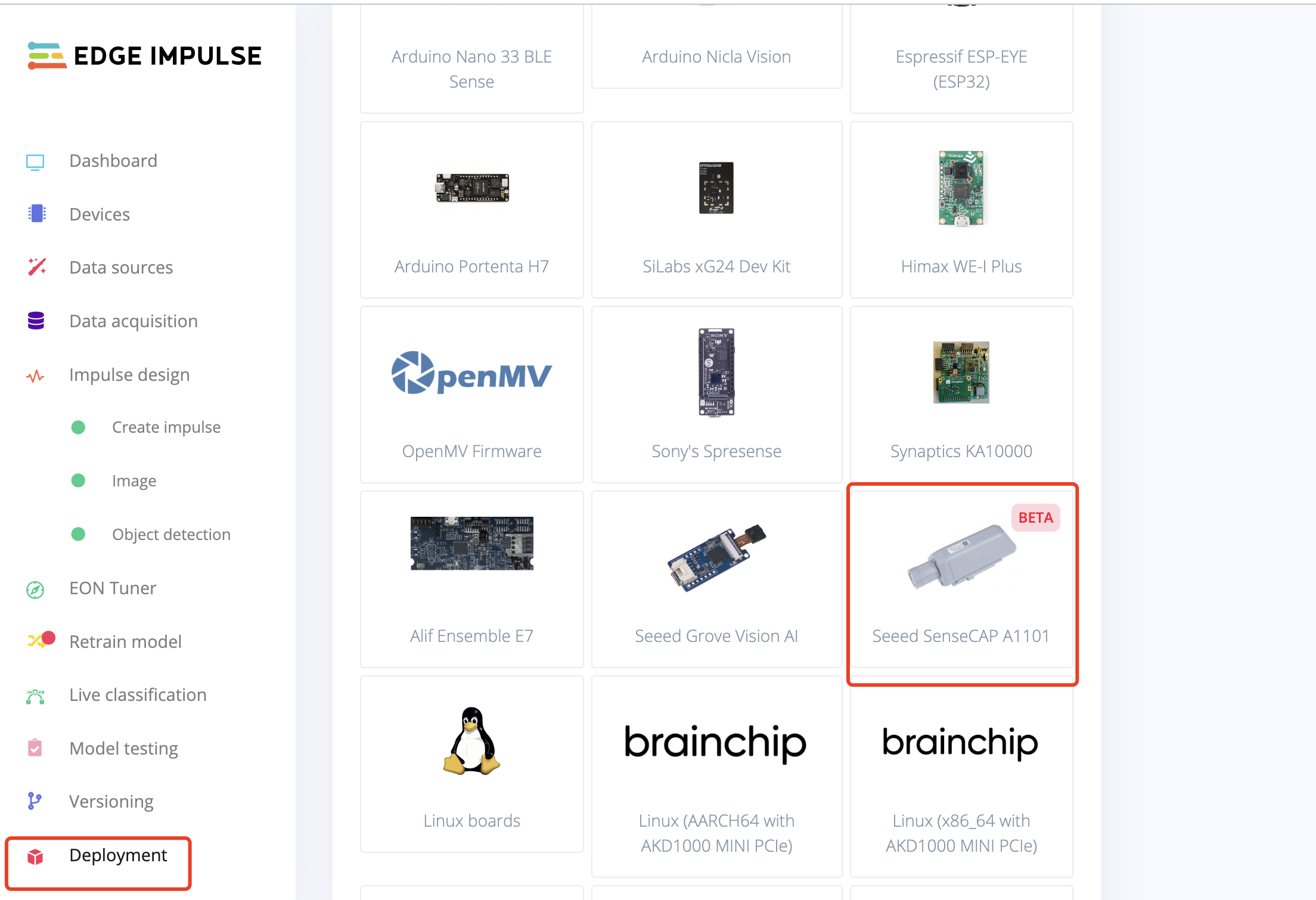

将模型部署到 A1101 - Vision AI

构建机器学习模型并从 Edge Impulse Studio 下载 Edge Impulse 固件后,按照更新 Edge Impulse 固件部分下的步骤 1 和 2,将模型 uf2 部署到 SenseCAP - Vision AI。 将 firmware.uf2 文件从 EDGE IMPULSE 拖放到 SENSECAP 驱动器。

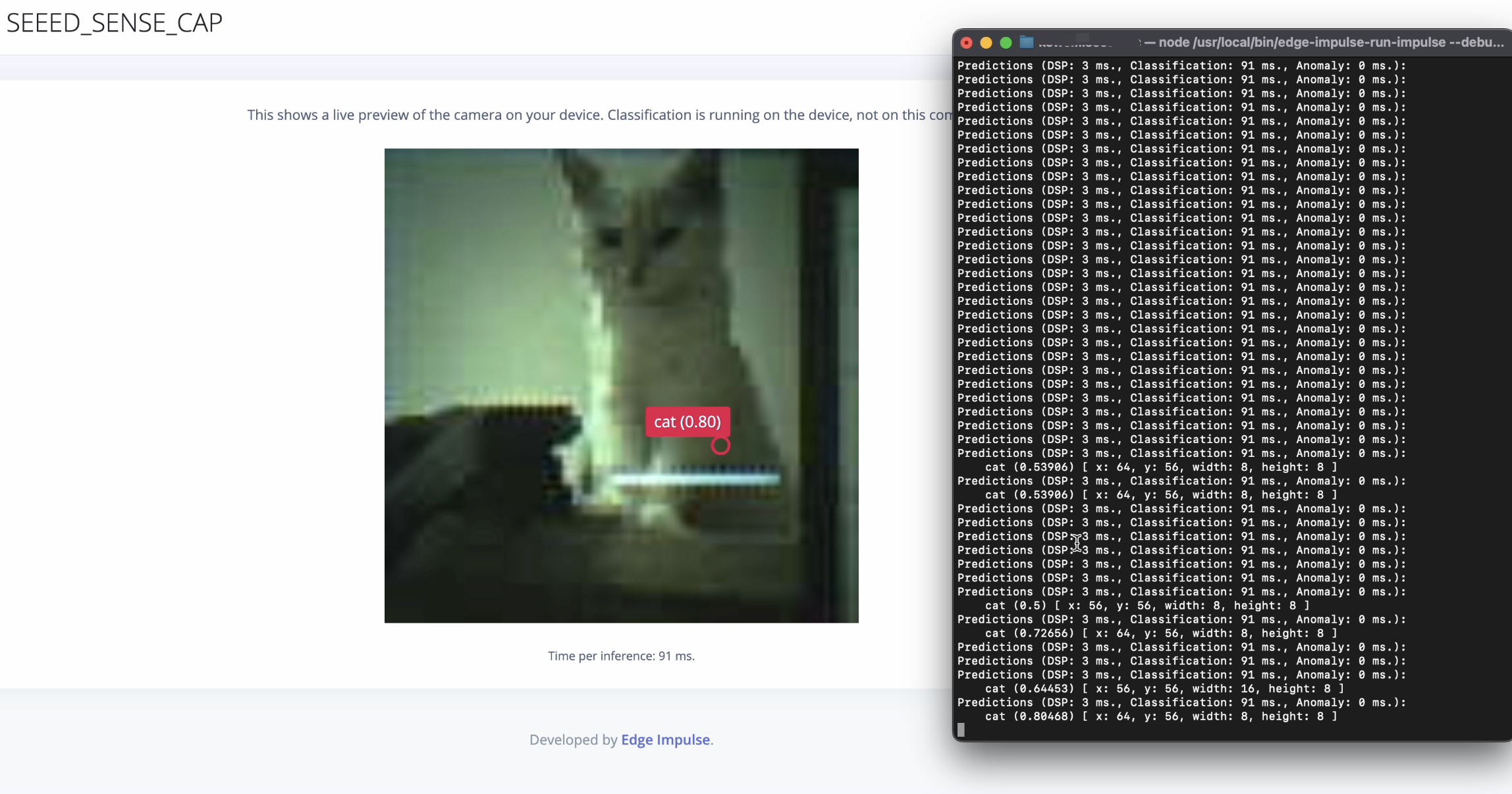

当您在本地界面上运行时:

edge-impulse-daemon --debug

它会要求您点击一个URL,然后您将在设备上看到摄像头的实时预览。

在SenseCap Mate上配置您的模型

- 下载SenseCAP Mate

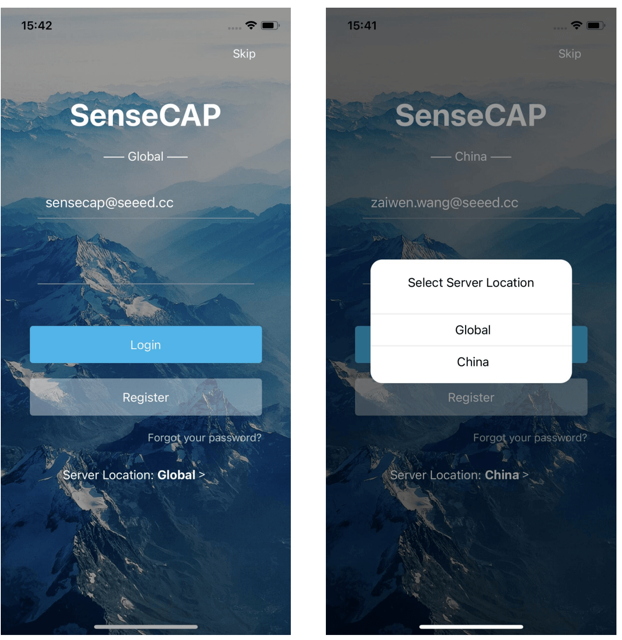

- 打开SenseCAP Mate并登录

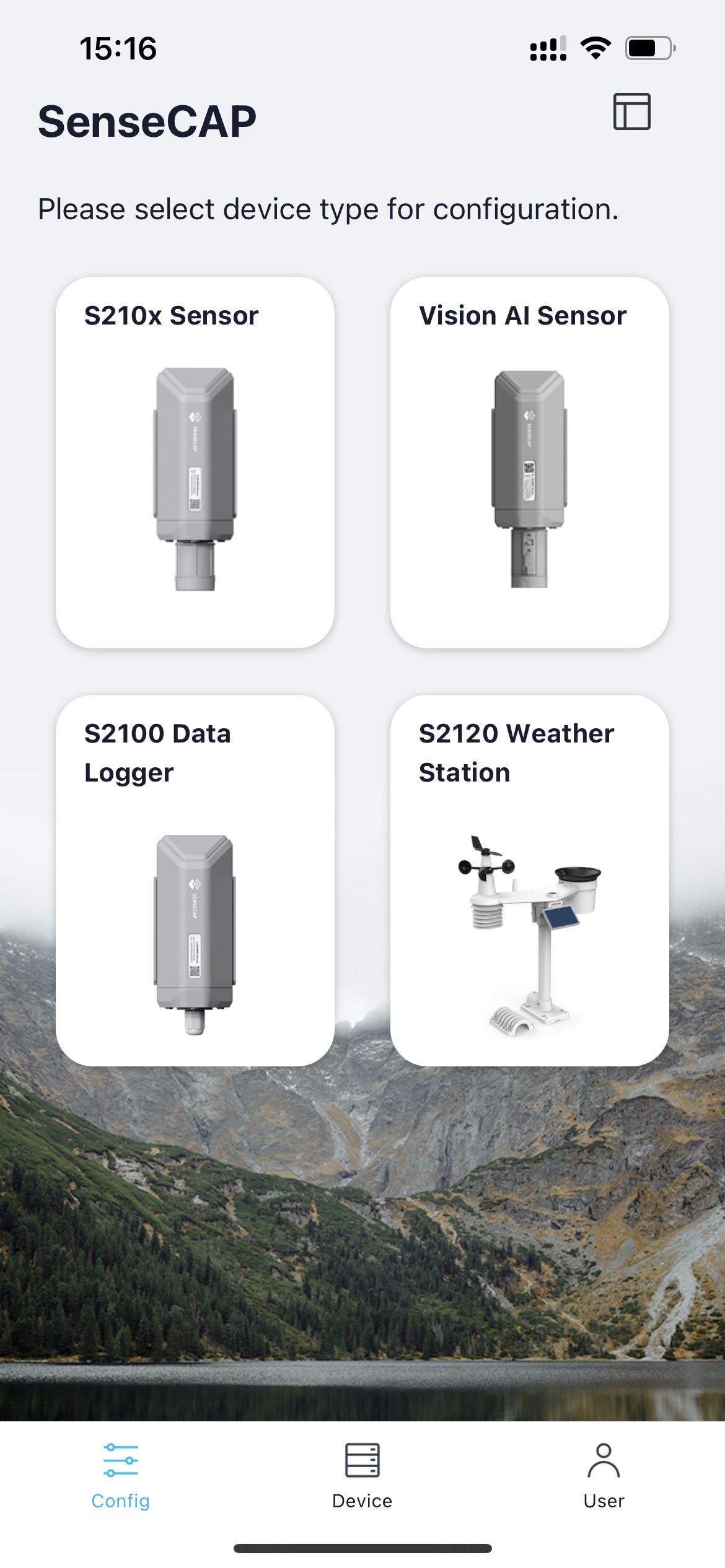

- 在配置界面下,选择Vision AI Sensor

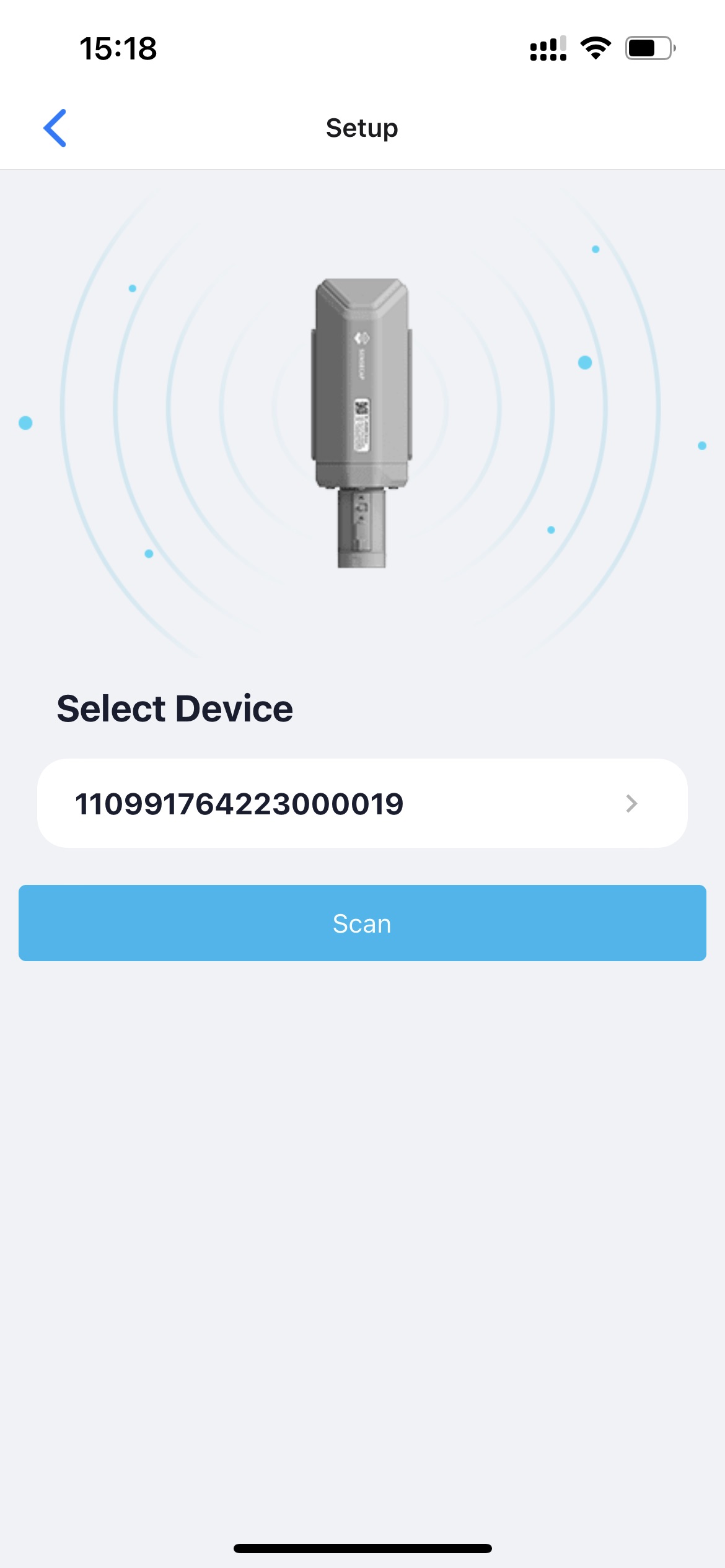

- 按住SenseCap A1101上的配置按钮3秒钟以进入蓝牙配对模式

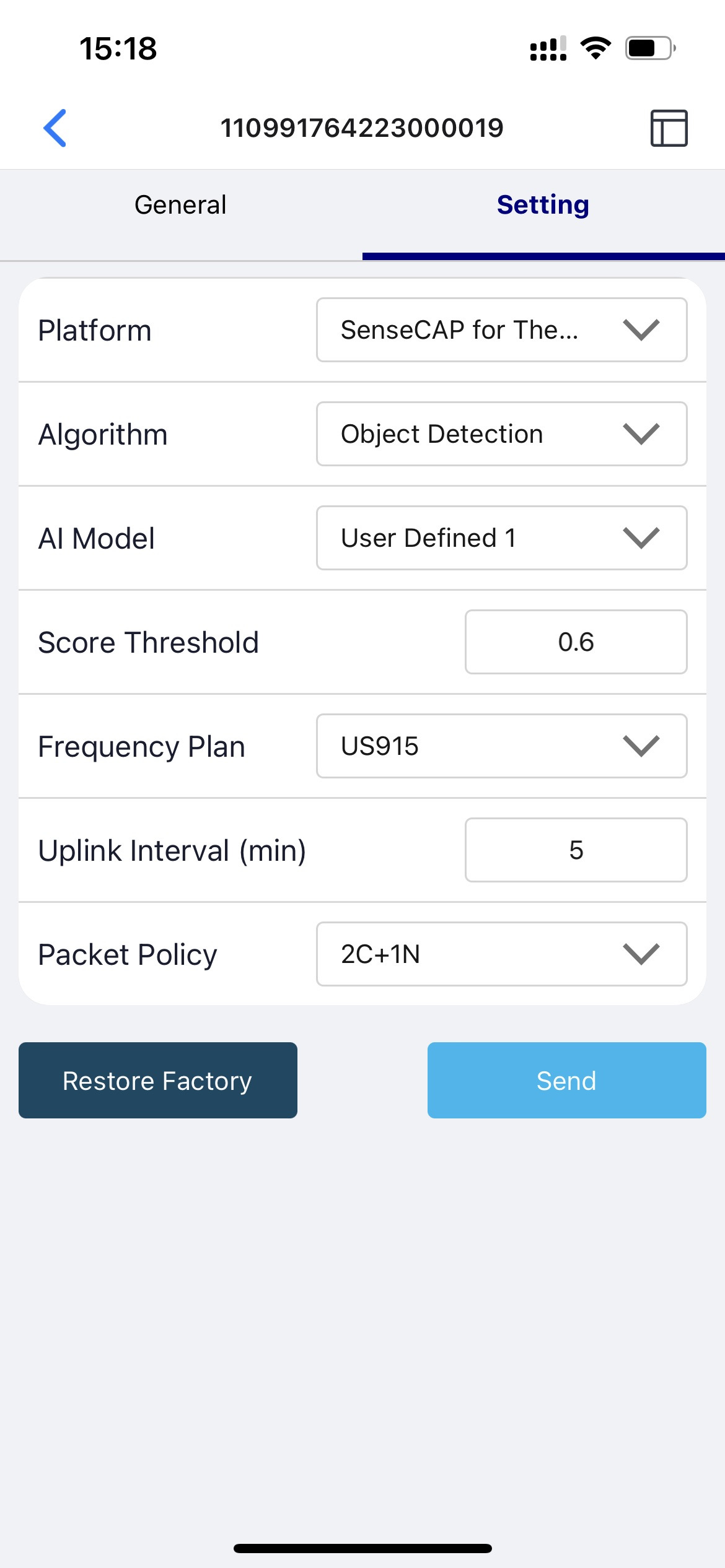

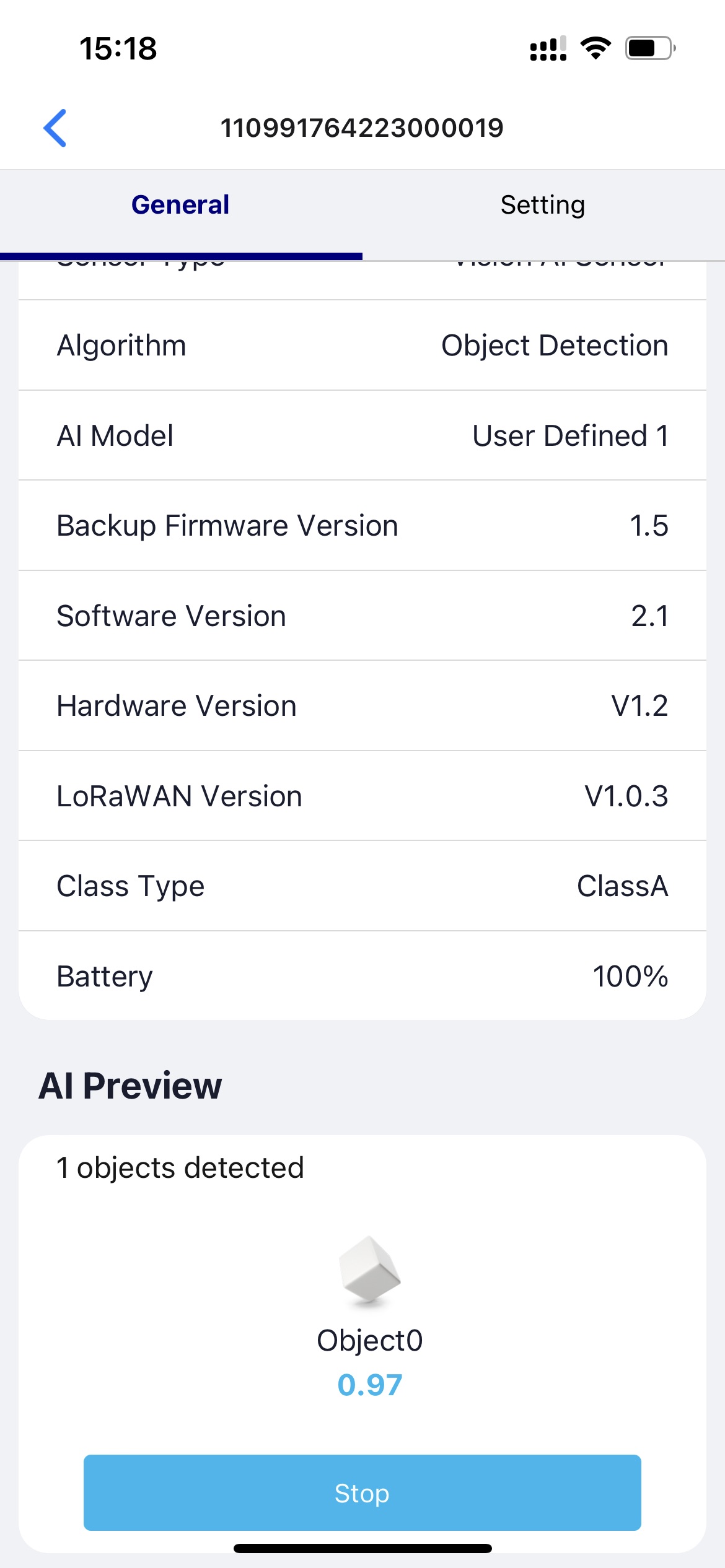

- 点击设置,它将开始扫描附近的SenseCAP A1101设备- 转到设置并确保选择了Object Detection和User Defined 1。如果没有,请选择它并点击发送

- 转到通用并点击检测

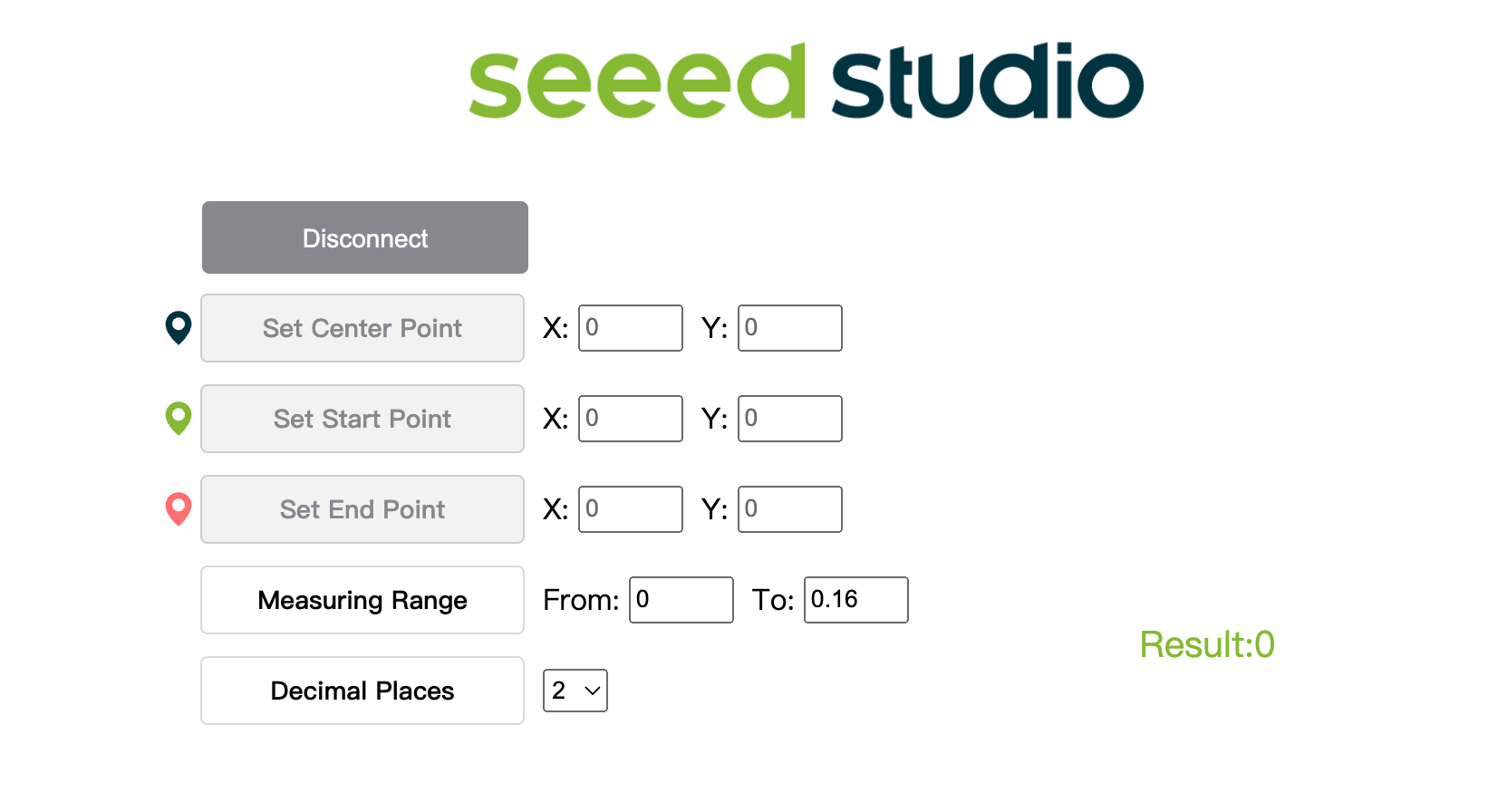

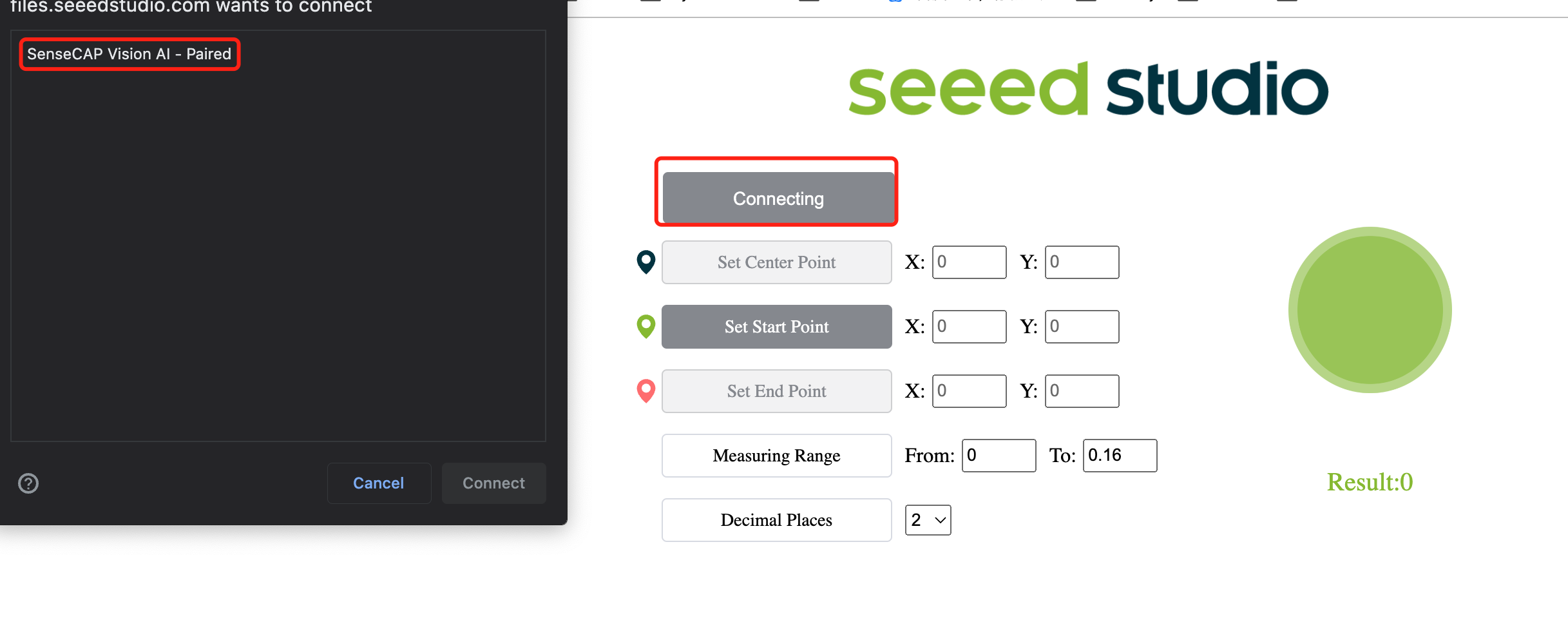

- 点击这里打开摄像头流的预览窗口

- 点击连接按钮。然后您将在浏览器上看到一个弹出窗口。选择SenseCAP Vision AI - Paired并点击连接

- 使用预览窗口查看实时推理结果!

例如,如上所示,猫被检测到并在它们周围有边界框。这里"0"对应于同一类别的每次检测。如果您有多个类别,它们将被命名为0,1,2,3,4等等。此外,每个检测到的苹果的置信度分数(上述演示中为0.72)也会显示!

技术支持与产品讨论

感谢您选择我们的产品!我们在这里为您提供不同的支持,以确保您使用我们产品的体验尽可能顺畅。我们提供多种沟通渠道,以满足不同的偏好和需求。