使用工具模块

在部署流程中,你可以一键插入 SenseCraft AI 集成功能。它们同时简化你的应用编写体验和终端用户的部署过程。

AI 视觉

在支持的硬件上部署用于目标识别、检测、分类等任务的 AI 视觉模型。推理结果可根据配置通过 MQTT、GPIO 或串口(Serial)实时流式传输。

该工具模块目前支持 检测(Detection) 和 分类(Classification)。分割和姿态估计计划在后续版本中提供。

支持的设备

选择模型

- SenseCraft AI model: 从模型库中选择社区公开共享的高质量模型。

- My model: 从你的私有已保存列表中选择模型。

- Upload model: 上传在第三方平台训练的模型文件。你需要提供模型名称、任务类型(

Task)、模型类别(Class ID和Class Name),附加模型文件,并选择支持的设备。上传完成后,模型会出现在 My model 下。 - Train model: 若要训练新模型或在现有模型基础上再训练,打开训练入口并按照向导操作。完成后,打开 Historical models,选择 Send to SenseCraft,完成上传流程,并将结果保存到 My model。

当你将包含私有模型的应用发布到社区时,该模型会自动变为公开模型。

选择设备

在下拉列表中,从该模型支持的设备列表里选择你实际使用的硬件。

推荐参数

根据你的场景微调推理和设备设置。这些数值会在部署时作为默认值写入设备。

- 置信度阈值(Confidence threshold): 判断模型是否输出最终预测的标准。提高阈值通常可以减少误报;降低阈值通常可以减少漏报。

- IOU 阈值(IOU threshold): 在检测任务中,IoU 用于比较预测框与真实框。较高的阈值有助于区分重叠目标,但如果设置过高,可能在同一目标上产生多个重复框;较低的阈值可以合并重复框,但如果设置过低,可能会把两个相近的目标合并为一个。

输出模式

- None: 上电后不会立即开始推理,直到有其他触发条件运行。适用于仅在需要时才运行推理的低功耗场景。

- MQTT: 上电后立即开始推理,并通过 Wi-Fi 使用 MQTT 发送结果。

- SenseCraft 官方服务(推荐): 为你的应用选择或创建一个 Dev Kit,MQTT 将自动完成配置。打开 SenseCraft Data 平台 以查看和处理接收的数据。

- 第三方服务: 使用你自己的或第三方的 MQTT broker,并手动配置参数。

- GPIO: 使用电平信号驱动 GPIO 引脚。

- 触发条件: 使用目标、条件和置信度阈值来定义规则。

- 触发动作: 当条件满足时,设备可以将引脚拉高/拉低、将抓拍保存到 SD 卡、点亮 LED 等。

- Serial: 使用 SSCMACore 库 通过 UART(GPIO)、I2C 或 SPI 导出推理数据。

**UART (GPIO)**

Baud Rate Value: 921600

Data Format: 8N1

TX: GPIO43

RX: GPIO44

**I2C**

Slave Address: 0x62

SDA: GPIO5 (PULLUP)

SCL: GPIO6 (PULLUP)

Protocol:

- READ:0x10,0x01, LEN << 8, LEN & 0xff

- WRITE: 0x10,0x02, LEN << 8, LEN & 0xff

- AVAIL(to read): 0x10,0x03

- RESET(clear buffer): 0x10,0x06

**SPI**

Slave CPOL0 CPHA0

MOSI GPIO9 (PULLUP)

MISO GPIO8,

SCLK GPIO7 (PULLUP)

CS GPIO4 (PULLUP)

Protocol:

- READ:0x10,0x01, LEN << 8, LEN & 0xff

- WRITE: 0x10,0x02, LEN << 8, LEN & 0xff

- AVAIL(to read): 0x10,0x03

- RESET(clear buffer): 0x10,0x06

AI 音频

在支持的硬件上部署用于语音识别的 AI 音频模型。结果可根据配置通过 MQTT、GPIO 或串口进行流式传输。

支持的设备

选择模型

- SenseCraft AI model: 从模型库中选择社区共享的模型。

- My model: 从你的私有列表中选择。

- Upload model: 上传在第三方平台训练的模型文件。提供模型名称和类别(

Class ID和Class Name)。上传完成后,模型会出现在 My model 下。 - Train model: 训练一个新的或更新后的模型,然后像视觉模型一样,从 Historical models 中将其发送到 SenseCraft。

当你将包含私有模型的应用发布到社区时,该模型会自动变为公开模型。

选择设备

音频模型目前仅支持 XIAO ESP32S3 Sense。

推荐参数

根据你的场景微调各项数值。

- 置信度阈值(Confidence threshold): 与视觉模型中的作用相同;用于在漏检和误检之间进行权衡调整。

- 输出模式(Output mode): 音频模型的默认输出路径。

AI 振动

通过学习“正常”振动并标记偏差来部署振动异常检测。

支持的设备

- XIAO ESP32S3 Sense(搭配 3 轴加速度计)

推荐参数

根据你的设置调整采样、上电行为、GPIO 和输出。

- 采样窗口(Sampling window): 每单位时间的采样数。窗口过大会减慢推理;过小则可能对正常振动拟合不足。

- 启用默认上电推理(Enable default power-on inference): 关闭时,上电不会自动开始推理;在低功耗使用场景下可使用外部触发。

- GPIO: 在检测到异常振动时驱动引脚——例如设置电平或切换 LED。

- 输出模式(Output mode): 振动模型的默认输出路径。

部署容器应用

只需几次点击即可将容器应用部署到边缘设备。

精选应用

内置应用库包括(并在持续扩展):

- Home Assistant — 开源家庭自动化中枢

- Ollama — 在边缘本地运行开源大语言模型

- OpenClaw — 用于部署和管理容器化边缘应用的开源平台

- reComputer AI Suite — 针对 reComputer 硬件优化的计算机视觉(CV)、视觉语言模型(VLM)和大语言模型(LLM)

兼容 M1 Gate、Raspberry Pi 4 / 5、NVIDIA Jetson 和 Seeed reComputer。

如何与 SenseCraft Fleet 协同工作

容器应用在 SenseCraft Fleet 上进行管理,并通过 SenseCraft AI(在 Applications 下)进行部署:

- SenseCraft Fleet 是容器镜像所在的平台——你在这里上传镜像、定义其配置模式,并绑定你的设备。

- SenseCraft AI 是你从应用库中选择应用、选择目标设备、进行配置并触发部署的平台。

你的 SenseCraft AI 账号会自动与 SenseCraft Fleet 关联;已绑定的设备和应用会在两个平台之间保持同步。

支持的平台

应用是特定于平台的——镜像和目标设备必须匹配:

- Linux / ARM64 — 例如 Seeed reComputer、Raspberry Pi 4 / 5、NVIDIA Jetson、M1 Gate

- Linux / AMD64 — 即将支持

配置工作流

选择应用: 从 SenseCraft Fleet 上的应用库(内置目录)中选择。如果你希望上传自定义容器应用,需要通过 SenseCraft Fleet 添加。

配置应用: 每个应用都会暴露其作者在 SenseCraft Fleet 上定义的配置项。通常你不需要配置任何内容,除非你有特殊需求。

部署工作流

步骤 1 — 选择应用: 点击 Deploy Container App。SenseCraft AI 会从 SenseCraft Fleet 加载你的完整应用库(内置目录加上你上传的所有自定义应用),并以名称、图标和描述的形式展示。

步骤 2 – 绑定设备: 如果你已经有已绑定的设备,请跳到步骤 3。否则,请先给设备上电,将其连接到网络,然后根据你的硬件类型进行绑定:

- 运行 Seeed 出厂镜像的 Seeed 设备: 输入设备 CPU ID 或 MAC 地址 的后 6 位即可立即绑定。

- 没有出厂镜像的 Seeed 设备,或第三方设备: 获取设备的 IP 地址,打开终端并通过 SSH 登录,然后运行绑定流程中显示的绑定命令。

绑定完成后,设备会出现在你的已绑定设备列表中。

步骤 3 — 选择目标设备: 从与应用平台兼容的已绑定设备列表中进行选择。不兼容的设备会被自动过滤掉。

步骤 4 — 配置应用: 填写应用作者暴露的配置项。有关控件类型和默认值,请参阅上面的配置工作流部分。

步骤 5 — 一键部署: 点击 Deploy。SenseCraft AI 会显示实时进度指示器,并在每个阶段流式显示状态。如果任何步骤失败,具体错误会在弹窗中显示,方便你修复后重试。使用新参数重新部署即可更新现有部署——之前的部署会被自动替换。

目前支持单镜像 Docker 应用。Docker Compose(多容器应用)已在规划中。

烧录固件

直接在浏览器中将预编译的固件二进制文件烧录到 ESP32 设备,而无需安装单独的烧录工具。当你的固件已经编译好并包含所有参数时,请使用此方式。

支持的设备:

- Seeed Studio XIAO ESP32C3

- Seeed Studio XIAO ESP32C6

- Seeed Studio XIAO SAMD21

- Seeed Studio XIAO ESP32S3

- Seeed Studio XIAO ESP32S3 Sense

- Seeed Studio XIAO ESP32S3 Plus

- Seeed Studio XIAO nRF52840

- Seeed Studio XIAO nRF52840 Sense

- Seeed Studio XIAO nRF52840 Plus

- Seeed Studio XIAO nRF52840 Sense Plus

- Seeed Studio XIAO RP2040

- Seeed Studio XIAO RP2350

- Seeed Studio XIAO RA4M1

- Seeed Studio XIAO MG24

- Seeed Studio XIAO MG24 Sense

- Wio Terminal (D51R) (即将支持)

- Seeeduino Lotus (即将支持)

- Grove Beginner Kit for Arduino (即将支持)

前提条件:

一个合并后的单一 .bin 文件。 如果你有单独的 bootloader、分区和应用二进制文件,请在上传前将它们合并。

- Arduino IDE 2.x: 只有在运行 Sketch → Export Compiled Binary 时才会生成合并后的二进制文件。输出的

*.ino.merged.bin会写入到与你的.ino文件同级的build/文件夹中。 - 旧版 Arduino IDE / 手动合并: Export Compiled Binary 会分别导出 bootloader、分区和应用的

.bin文件——在上传前使用esptool.py merge_bin将它们合并。请参阅 Seeed Studio 论坛指南:How to export a single merged.binfile from Arduino IDE。

配置工作流

- 点击 Upload firmware 并上传你的

.bin文件。 - 从下拉菜单中选择设备类型。

部署工作流

- 将设备连接到你的电脑。

- 点击 Flash firmware。按钮会显示当前阶段,并在下方显示进度条和调试日志:连接串口 → 检测设备 → 烧录 → 重启。

- 烧录完成后,在预览窗口中验证设备行为。

如果任何步骤失败,会弹出错误提示,说明原因,方便你修复后重试。

Node-RED

Node-RED 模块可帮助你为 reCamera 构建可视化逻辑流程。

官方资源

支持的设备

准备你的工作流

添加 Node-RED 模块后,可以通过以下任一方式配置流程:

- 创建新工作流: 连接到 reCamera(有线或无线),打开其 Dashboard,并在线编辑。

- 上传本地文件: 上传你已经构建好的 JSON 流程。系统会验证文件类型,以确保可以可靠解析。

选择 AI 视觉模型

JSON 流程不会内嵌模型二进制文件。请指定此流程应使用的模型:

- 设备内置: 使用预装在 reCamera 上的模型,包括用于分类、检测、分割和姿态估计的 YOLO11n 变体。

- 公共模型: 浏览其他人为 reCamera 共享的 SenseCraft 公共模型。

- 我的模型: 从你的私有模型库中选择。

如果你在 My model 下使用私有模型并将应用发布到公共社区,该模型也会被公开。在发布前系统会提示你确认。

Aily Blockly

Aily Blockly 是一个可视化编程环境。通过此模块,你可以一键将自己在 Aily Blockly 中构建的程序烧录到边缘设备。

Aily Blockly 是一个可视化编程环境。通过此模块,你可以一键将自己在 Aily Blockly 中构建的程序烧录到边缘设备。

官方资源

支持的设备

- Seeed Studio XIAO ESP32C3

- Seeed Studio XIAO ESP32C6

- Seeed Studio XIAO SAMD21

- Seeed Studio XIAO ESP32S3

- Seeed Studio XIAO ESP32S3 Sense

- Seeed Studio XIAO ESP32S3 Plus

- Seeed Studio XIAO nRF52840

- Seeed Studio XIAO nRF52840 Sense

- Seeed Studio XIAO nRF52840 Plus

- Seeed Studio XIAO nRF52840 Sense Plus

- Seeed Studio XIAO RP2040

- Seeed Studio XIAO RP2350

- Seeed Studio XIAO RA4M1

- Seeed Studio XIAO MG24

- Seeed Studio XIAO MG24 Sense

- Wio Terminal (D51R)

- Seeeduino Lotus

- Grove Beginner Kit for Arduino

绑定项目 ID

输入指向你公共 Aily Blockly 模板的项目代码。

如何获取项目 ID

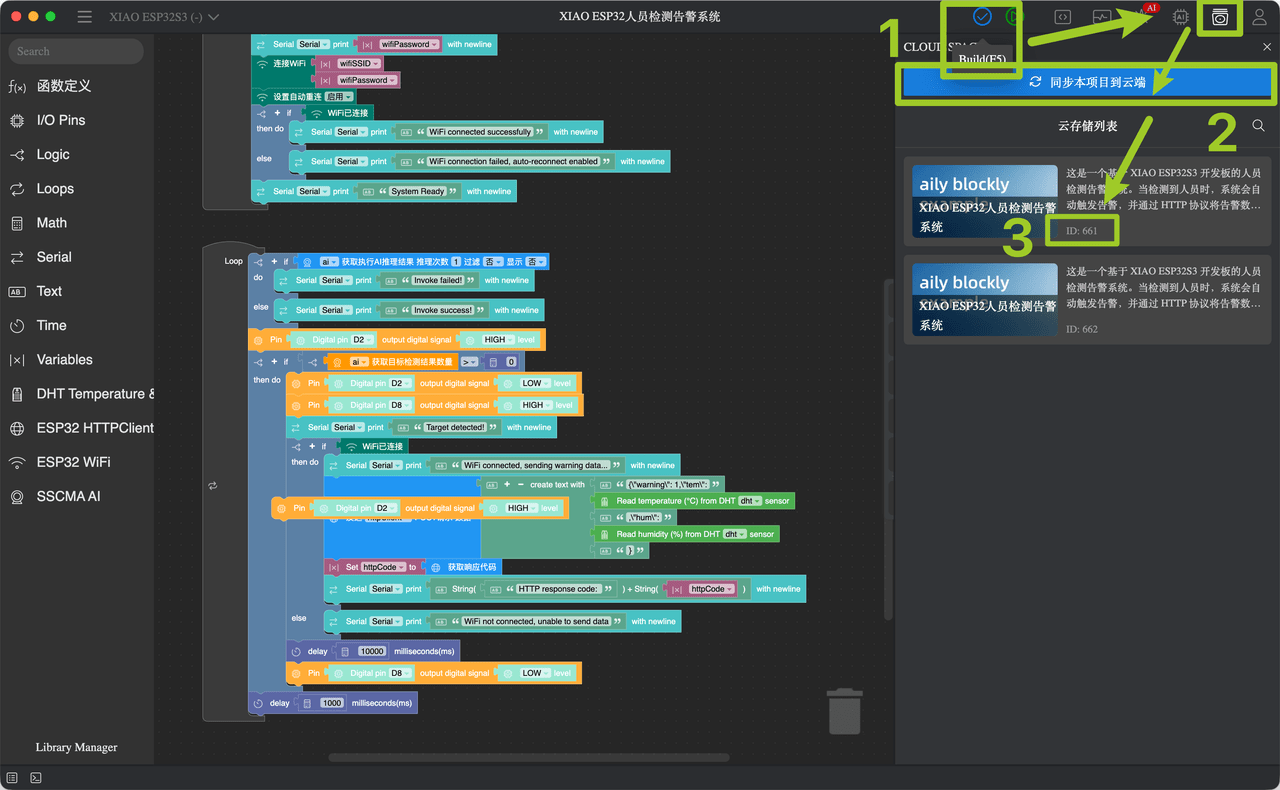

- 在 Aily Blockly 中构建你的项目,然后点击

Build (F5)进行编译。 - 编译成功后,打开 Cloud Space 面板并点击

Sync this project to cloud。 - 你的项目 ID 会显示在标记区域(

ID: …)中,只使用其中的数字。 - 每当你更改项目时重复这些步骤,以确保云端副本保持最新。