JetsonでのVoice LLMによるモーター制御

はじめに

このwikiでは、Jetsonプラットフォーム(reComputer Robotics J4012)をベースとしたエンドツーエンドの音声制御モーターシステムを構築し、音声認識、エッジ大規模言語モデル(LLM)意図理解、ハードウェア制御を統合して自然な人間-機械間相互作用を実現します。ユーザーは簡単な音声コマンド(例:「時計回りに90度回転」)でMyActuator X Seriesモーターを制御できます。

前提条件

- reComputer Robotics J4012

- reSpeaker XVF3800

- MyActuator X Seriesモーター

| reComputer Robotics J4012 | reSpeaker XVF3800 | MyActuator X Seriesモーター |

|---|---|---|

|  |  |

ハードウェア接続

はじめに

システム全体のワークフローは3つのステップで構成されています:

- ASR:マイクがユーザーからの音声コマンドを取得し、Whisperを使用してテキストに変換します。

- 関数呼び出し:大規模言語モデルがユーザーの入力指示に基づいて要件を満たすモーター制御パラメータを生成します。

- モーター制御:適切な制御プログラムが呼び出され、モーターを指定された位置まで回転させます。

次に、各ステップの実装について詳しく説明します。

Whisperサーバーのインストール

まず、ASR機能を有効にするためにWhisperサービスをインストールする必要があります。Jetsonデバイスでターミナルウィンドウを開き、以下のコマンドを実行してください。

git clone https://github.com/jjjadand/whisper-stable4curl

cd whisper-stable4curl

export PATH=/usr/local/cuda-12.6/bin${PATH:+:${PATH}}

export LD_LIBRARY_PATH=/usr/local/cuda-12.6/lib64${LD_LIBRARY_PATH:+:${LD_LIBRARY_PATH}}

cmake --build build -j --config Release

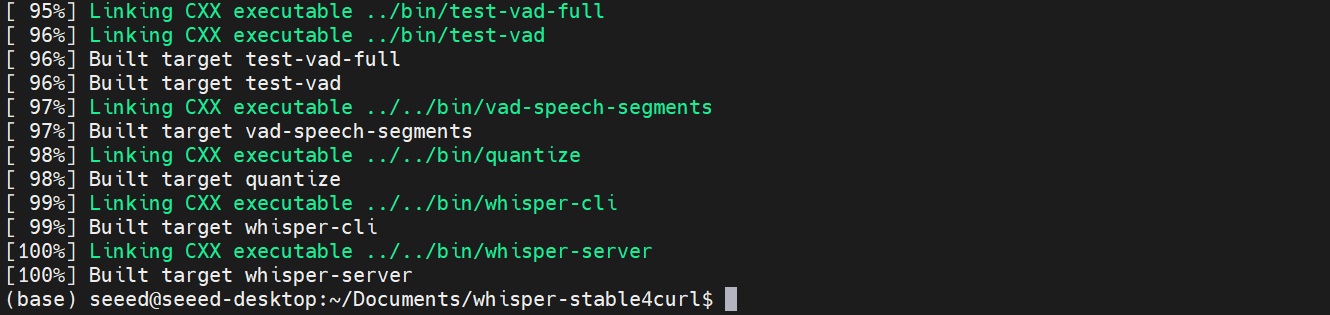

すべてが正常に動作すれば、ターミナルウィンドウに以下のログが表示されます。

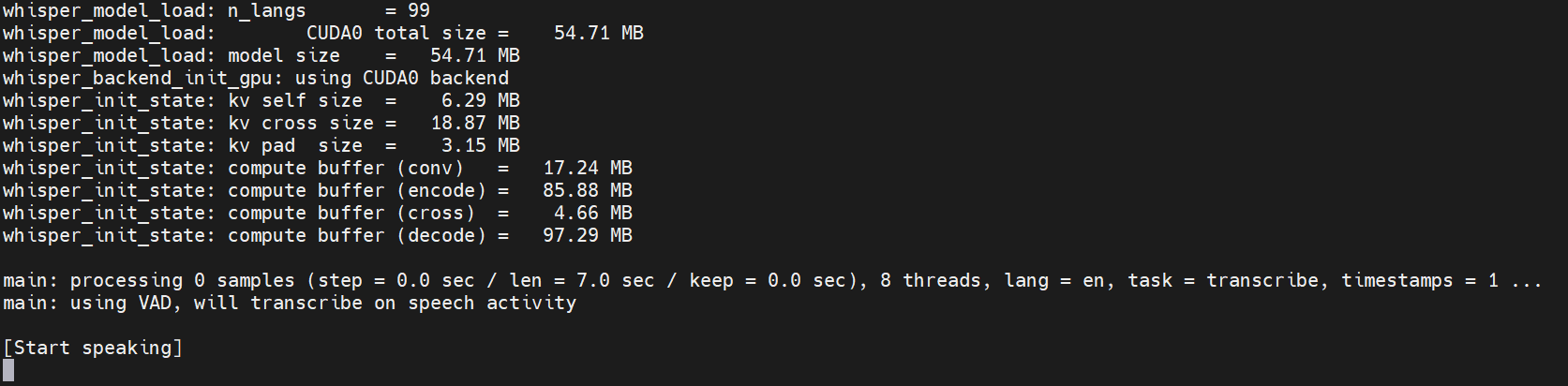

次に、Whisper推論サービスを起動します:

./build/bin/whisper-stream -m ./models/ggml-base.en-q5_1.bin -t 8 --step 0 --length 7000 -vth 0.7 --keep 1200

Ollama のインストール

Ollama は非常にユーザーフレンドリーなエッジコンピューティング LLM 推論フレームワークで、単一のコマンドで Jetson にデプロイできます。Jetson デバイスで新しいターミナルウィンドウを開き、以下を実行してください:

curl -fsSL https://ollama.com/install.sh | sh

ollama pull qwen2.5

備考

ここでは、Qwen 2.5大規模言語モデルを使用してユーザーの意図を理解します。

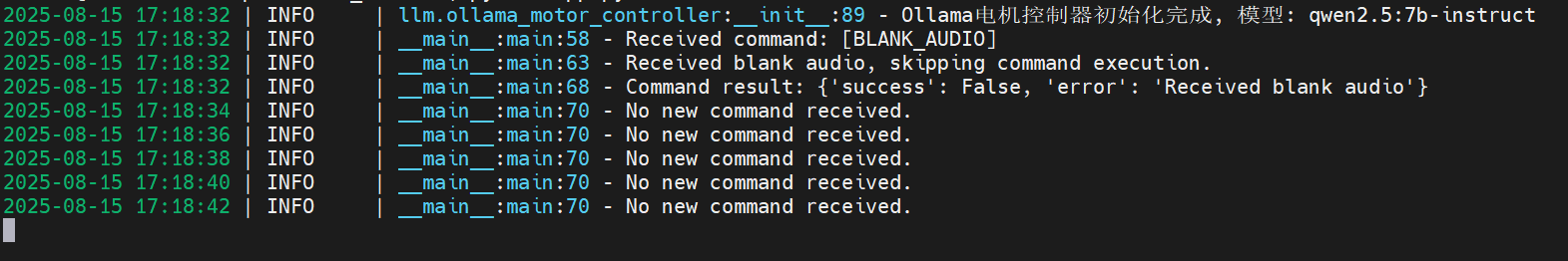

モーター制御スクリプトのインストール

以下のコマンドを実行してモーター制御スクリプトを開始します:

git clone https://github.com/yuyoujiang/voice_control.git

cd voice_control

sudo ip link set can0 type can bitrate 1000000

sudo ip link set can0 up

python app.py

効果デモンストレーション

技術サポート & 製品ディスカッション

私たちの製品をお選びいただき、ありがとうございます!私たちは、お客様の製品体験が可能な限りスムーズになるよう、さまざまなサポートを提供しています。異なる好みやニーズに対応するため、複数のコミュニケーションチャンネルを用意しています。