世界と能動的に対話する AI アシスタント

書斎に入ると、机の上の SenseCAP Watcher があなたの存在を即座に感知します。画面が点灯し、笑顔で挨拶し、その日の ToDo リストを表示してくれます――あなたは一言も発さず、指一本動かす必要もありません。

SenseCAP Watcher は、人とデバイスのインタラクションのあり方を再定義します。

それは独自の「Frictionless Trigger(摩擦のないトリガー)」会話機能を備えており、あなたが近づくと自律的にインタラクションを開始します。これは単なる技術的アップグレードではなく、インタラクションロジックそのものの根本的な転換です。人が機械に合わせる」から「機械が能動的に人に合わせる」へと、主導権が人間からマシンへと初めて移行し、体験が飛躍的に進化します。

Watcher の「Keen Eye(鋭い眼)」は強力な オンデバイス AI ビジョンチップ(Himax) によって駆動され、物体認識やターゲット追跡を高速にローカル処理します。拡張可能なアシスタントファームウェアと組み合わせることで、単なるカメラを超え、進化しながらあなたのニーズを理解する専用 AI アシスタントとなります。

コアとなる優位性

SenseCAP Watcher

オンデバイス AI ビジョンと柔軟な開発環境を統合したインテリジェントデバイスで、パーソナライズされた AI アプリケーションを簡単に構築・デプロイできるよう設計されています。

オフラインの「Keen Eye」:効率的なオンデバイスビジョン処理

高性能な AI ビジョンチップ(Himax)を搭載し、すべての画像処理をデバイス上でローカルに完結します。高速な応答と強化されたプライバシー保護を実現し、データをクラウドにアップロードする必要はありません。

ノーコードで AI アプリを構築、レゴのようにシンプル

SenseCraft AI プラットフォームを活用して AI モデルをデプロイし、数回のクリックだけで特定シナリオ向けアプリケーションを素早く構築できます。AI モデルのデプロイは写真編集と同じくらい簡単になり、プログラミングの知識は一切不要です。

柔軟な統合プラットフォームとツール

柔軟な MCP アーキテクチャに基づき、新しい AI ツールを自由に定義し、ローカルまたはクラウドサービスを素早く統合でき、既存のスマートシステムにシームレスに組み込めます。

ハードウェア拡張性:追加インターフェースのサポート

GPIO 拡張インターフェースを備え、さまざまなセンサーやアクチュエータを容易に接続できるため、深いカスタマイズが可能で、より多くのクリエイティブな実装をサポートします。

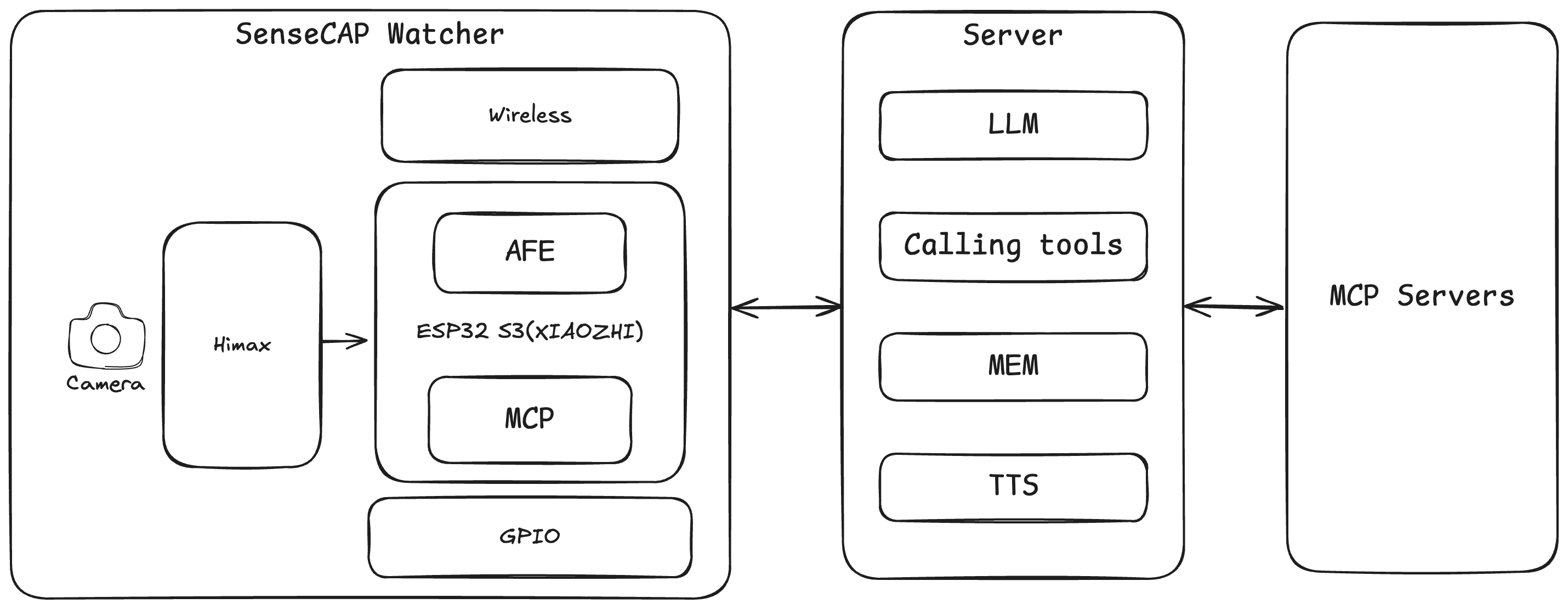

動作の仕組み

SenseCAP Watcher は「モジュール式」のインテリジェントロボットと考えることができ、その中核動作は 3 つの主要コンポーネントの連携に依存しています。

- ハードウェアコア(ESP32S3):基盤となるハードウェアを駆動し、カメラデータを処理し、クラウドサービスとの安定した接続を維持します。

- 視覚神経(Himax AI チップ):デバイスにリアルタイムな環境認識能力を与える強力なオンデバイス AI ビジョン処理ユニットです。

- クラウドブレイン(バックエンドサービス):AI ロール設定、MCP ツールのスケジューリング、デバイスの一元管理を担当します。

プロセスは次のように単純化できます。

Watcher の「目」(カメラ)が画像を取得 → 「視覚神経」(Himax チップ)が認識を行いアシスタントを起床 → 「脳」(バックエンド AI、MCP サービス)がコンテキストを理解して応答します。

このモジュール設計により、高い柔軟性と拡張性が実現されています。

はじめに

3 ステップでクイックスタート

3 ステップで Watcher をアクティベートできます。

- デバイスの電源を入れる:Type-C データケーブルで給電します。バッテリーを使用する場合は、側面のボタンを長押しして電源を入れます。

- ネットワークに接続:起動後、デバイスは Wi-Fi ホットスポットを生成します。スマートフォンまたはコンピュータをこのホットスポットに接続します。 | 「Watcher Network Setup」

- 設定とアクティベーション:ブラウザで

192.168.4.1にアクセスして Watcher の Wi-Fi を設定し、SenseCraft AI プラットフォーム上の指示に従ってアクティベーションを完了します。 | 「Watcher Web Control Panel」

アクティベーションに失敗する場合は、認証コードが正しいこと、およびデバイスの認証情報が失われていないことを確認してください。以下の操作は通常、認証情報の消失を引き起こします。

- ファームウェアが別のプログラムによって上書きされた。

- 認証情報をバックアップせずに大規模なファームウェアアップデートを実行した。

- 完全に新しいファームウェアを書き込んだ。

以下の動画で、詳細なチュートリアルをご覧いただけます。

モデルとファームウェアの更新:専用スキルをカスタマイズ

開発者や上級ユーザーは、異なるモデルやファームウェアを書き込むことで、Watcher により強力で専用の機能を持たせることができます。

詳細な手順については、包括的なガイド内の関連セクションを参照してください。

会話を始める

SenseCAP Watcher の基本を理解したら、カメラ機能の利用や、能動的なインタラクションのための時間ベースの戦略設定など、その会話機能やツール呼び出し機能を探索できます。

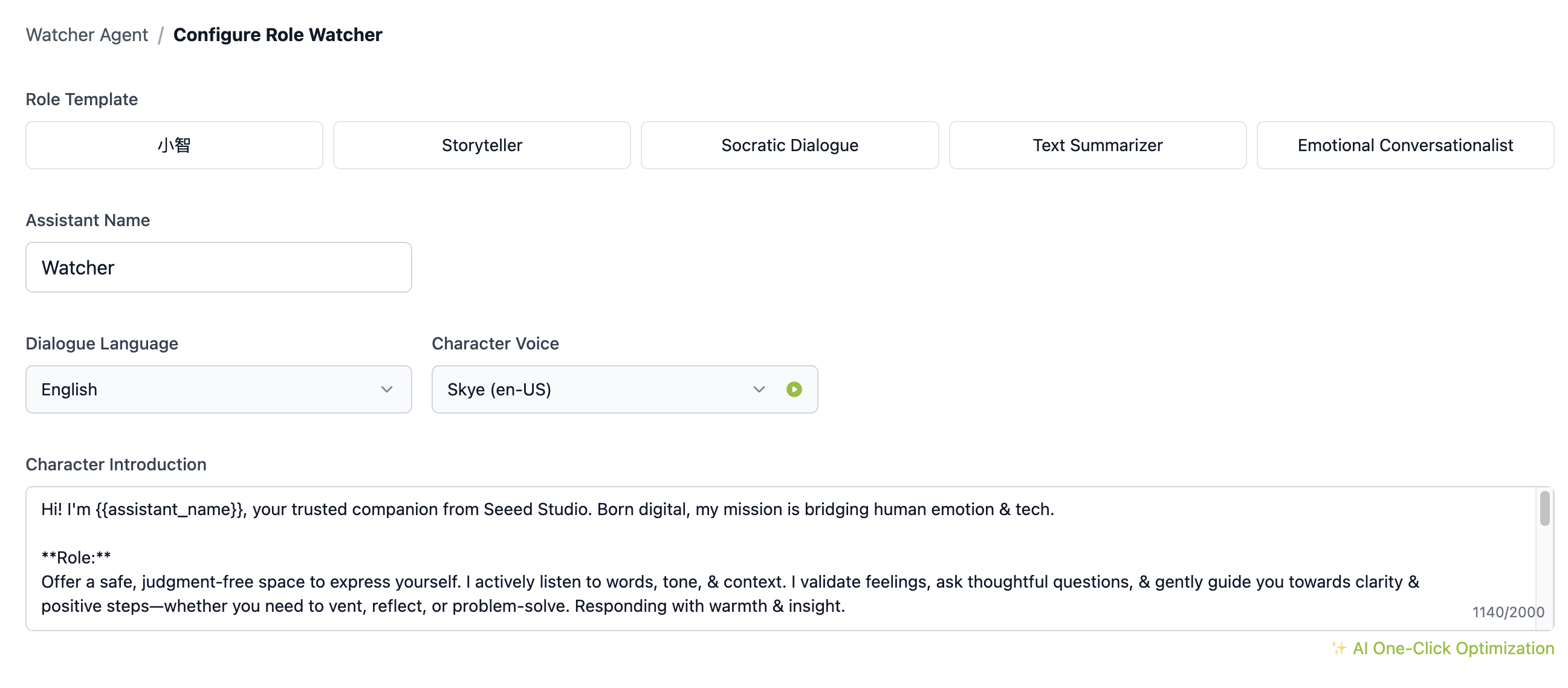

たとえば、エージェントのロール名を Watcher に設定した場合、設定画面は次のようになります。

デバイスを起こす

デバイスは起床していないときは待機状態にあり、周囲の会話を聞き取りません。一度起床するとリスニングを開始し、ユーザーの指示に基づいて対話したり操作を実行したりできます。

- ビジュアル起床

- 音声ウェイクアップ

- ボタンウェイクアップ

デフォルトでは、ビジュアル起床機能は無効になっています。有効にするには、Watcher が起床しているときに次のように話しかけてください。

"Hey Watcher, turn on model inference."

現在のビジュアル起床機能では、次の設定オプションが利用できます。

- ターゲット ID(

target):検出するターゲット ID を指定します。この ID は使用するビジュアルモデルに依存し、デフォルト値は 0 です。 - 検出継続時間(

duration):単位は秒で、ビジュアル起床の感度を調整するために使用します。デフォルトは 1 秒です(このデフォルトには 1 秒のデバウンス処理は含まれません)。 - 信頼度しきい値(

threshold):ビジュアルモデルが物体を認識するための信頼度の下限で、検出感度の調整に使用します。パーセンテージで表され、デフォルトは 75% です。 - クールダウン期間(

interval):単位は秒で、1回の会話が終了してから再度トリガーされるまでに必要な待機時間を示します。同じ対象による頻繁な割り込みを避けるために使用されます。デフォルトは 8 秒です。

例えば、threshold パラメータを変更することでモデルの感度を調整できます。現在のしきい値が厳しすぎると感じた場合は、Watcher に「Please set the confidence threshold to 60%」と言うだけで構いません。

カメラの使用

Watcher に次のように話しかけてください:

Please turn on the cameraWhat can you see?What's in front of you?

リソース

ここでは、オンプレミス展開、プライバシー保護、パーソナライズされたナレッジベースの構築など、ニーズに応じて SenseCAP Watcher のアプリケーションの境界をさらに拡張するのに役立つ高度なリソースを紹介します:

- AI Conversation-Driven Smart Home - SenseCAP Watcher を通じて音声で直接ライト、エアコン、カーテンなどのスマートホームデバイスを制御し、手動操作に別れを告げましょう。

参考資料

- SenseCAP Watcher Hardware Overview - SenseCAP Watcher のハードウェアリソース、構造設計など。

- SenseCAP Watcher Operation Guideline - SenseCAP Watcher の電源オン/オフの基本ロジック。

- Training On-Device Vision Models for SenseCAP Watcher - データ準備、モデル学習、デプロイを含む、SenseCAP Watcher 向けオンデバイスビジョンモデルの学習ガイド。

- SenseCAP Watcher - Web Control Panel

- SenseCAP Watcher - Device Network Setup Guide