LLM Local Personalizado: Ajuste Fino de LLM com Llama-Factory no Jetson

Introdução

🚀Faça ajuste fino de LLM com Llama-Factory no Jetson! Agora você pode personalizar um LLM local privado para atender às suas necessidades.

Llama-Factory fornece uma ferramenta de ajuste fino de modelos de linguagem grande extremamente conveniente, que suporta modelos de linguagem grandes comuns, conjuntos de dados e métodos de ajuste fino. Com essa plataforma, podemos facilmente personalizar modelos de linguagem grandes privados.

Neste wiki, vamos aprender como implementar o Llama-Factory no Nvidia Jetson e usar o Llama-Factory para treinar um modelo de linguagem grande que suporte perguntas e respostas em chinês.

Pré-requisitos

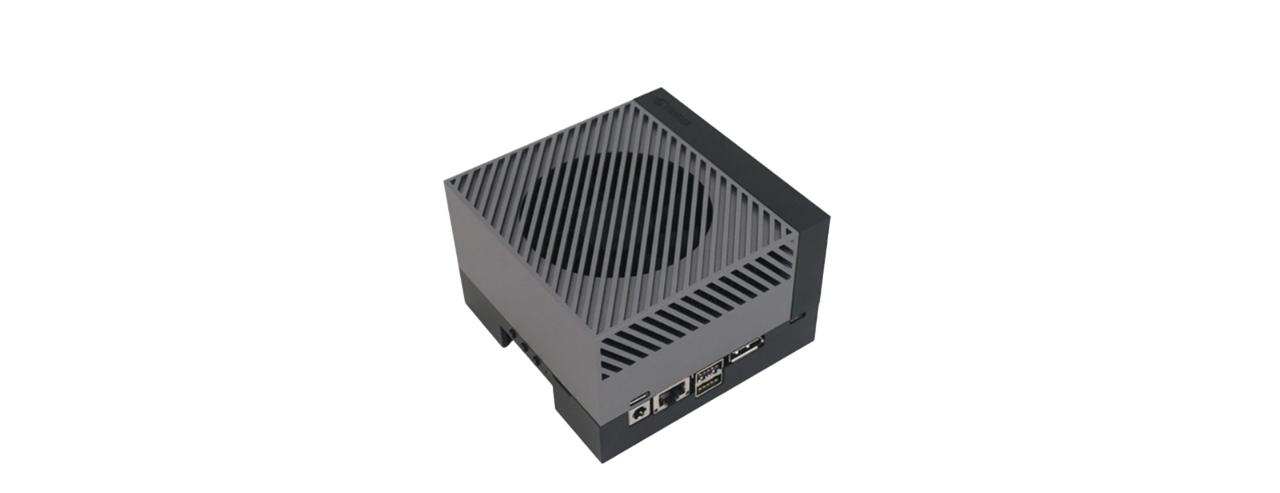

- Dispositivo Jetson com mais de 16 GB de memória.

- Monitor, mouse, teclado e rede. (não obrigatório)

Já testamos a viabilidade deste wiki no reComputer Orin NX 16GB e no Kit de Desenvolvimento AGX Orin 64GB.

Primeiros Passos

Conexão de Hardware

- Conecte o cabo Ethernet ao reComputer (com Jetson).

- Conecte o mouse, o teclado e o monitor ao reComputer.

- Ligue o reComputer.

Instalar Jetson-Examples

O jetson-examples da Seeed Studio oferece uma implantação perfeita, com um único comando, para executar modelos de visão computacional e IA Generativa na plataforma NVIDIA Jetson.

Para instalar o pacote, abra o terminal no Jetson e execute:

pip3 install jetson-examples

sudo reboot

Instalar e Executar Llama-Factory no Jetson

Implemente o Llama-Factory com o jetson-examples em uma única linha:

reComputer run llama-factory

Em seguida, podemos abrir um navegador web e acessar o endereço para abrir a WebUI:

# http://<jetson-ip>:7860

http://127.0.0.1:7860

Iniciar o Treinamento

Aqui, usamos o conjunto de dados alpaca_zh para fazer o ajuste fino do modelo Phi-1.5, permitindo que ele tenha capacidades de conversação em chinês. Portanto, na interface web, configuramos apenas o Model name de treinamento e o Dataset, mantendo os outros parâmetros de treinamento como padrão.

Por fim, clique no botão start para iniciar o treinamento.

O processo de treinamento levará aproximadamente 18 horas.

Após concluir o ajuste fino, você pode encontrar o modelo ajustado no diretório de salvamento.

Testando o Modelo com Ajuste Fino

Por fim, podemos usar o Llama-Factory com o modelo ajustado para testar se ele de fato adquiriu capacidades de conversação em chinês. Os passos específicos são os seguintes.

Passo 1. Carregue o modelo ajustado pela Llama-Factory WebUI.

Passo 2. Digite um prompt em chinês na caixa de texto Input, clique no botão Submit e verifique o resultado de saída do modelo de linguagem grande na caixa de texto Chatbot.

Pelos resultados do teste, podemos ver que o modelo ajustado já tem a capacidade de conversar com humanos em chinês. Se você quiser que seu modelo tenha capacidades mais avançadas, tente usar um conjunto de dados de ajuste fino mais diverso para treinar seu modelo!

Demonstração

Referências

- https://github.com/hiyouga/LLaMA-Factory

- https://github.com/dusty-nv/jetson-containers

- https://github.com/Seeed-Projects/jetson-examples

Suporte Técnico & Discussão de Produtos

Obrigado por escolher nossos produtos! Estamos aqui para fornecer diferentes tipos de suporte para garantir que sua experiência com nossos produtos seja a mais tranquila possível. Oferecemos vários canais de comunicação para atender a diferentes preferências e necessidades.