Primeiros Passos com o Gapi em Dispositivos NVIDIA® Jetson

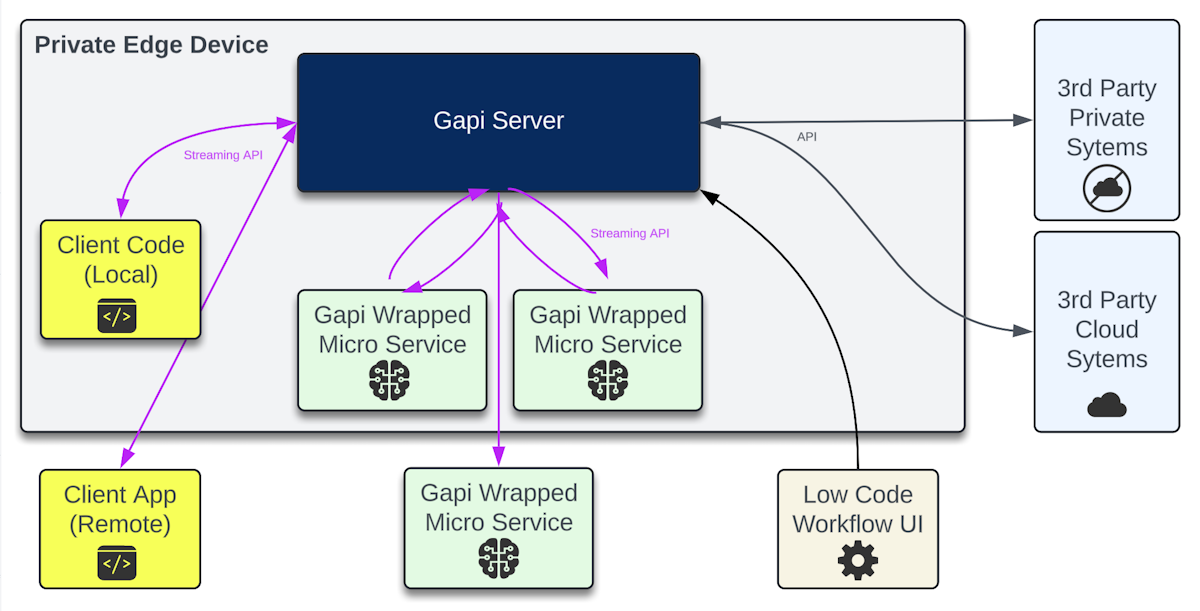

Gapi é um API gateway incorporável que cria integrações de streaming entre microsserviços de IA e os sistemas que os usuários utilizam todos os dias.

O objetivo do projeto é acelerar a velocidade de criação de pilotos e demos das conquistas do Jetson AI Lab em ambientes do mundo real. IA generativa "On Device" não significa que ela tenha que viver em uma ilha!

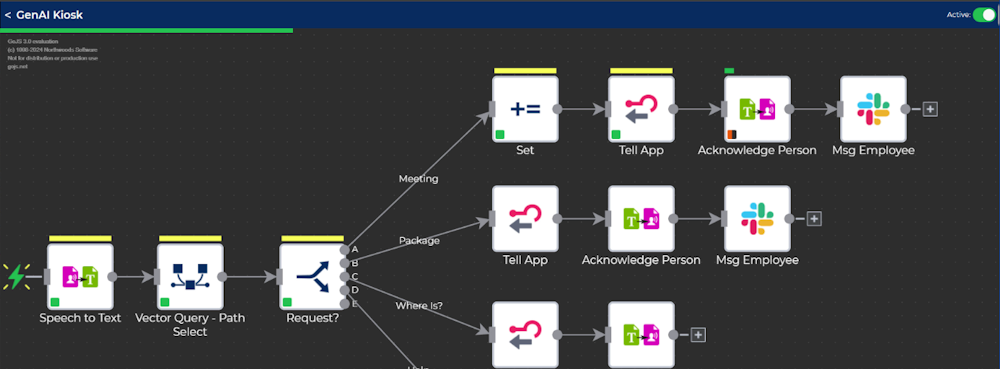

- Mecanismo de fluxo de trabalho com interface low code, com dezenas de integrações abertas e clientes personalizáveis para web móvel e desktop.

- Framework de microsserviços para encapsular contêineres Jetson (Ollama, Whisper, Piper TTS, etc. já estão prontos, com mais a caminho). Ou encapsule seus próprios modelos/códigos e integre-os aos Workflows.

- Mensageria em tempo real, híbrida, binária+json suaviza chamadas entre serviços e reduz a latência.

- Um caminho rápido para comprovar o valor da IA generativa para as partes interessadas em seu ambiente real.

Gapi Server

Software de API gateway incorporável que roda em segundo plano com uma interface de fluxo de trabalho low code para testes. O servidor é um hub de mensagens e máquina de estados para os "nós" do fluxo de trabalho que se comunicam com os Microsserviços. Pense nele como um tecido conectivo para aplicações.

Um Microsserviço é um processo que executa alguns scripts wrapper em python que integram códigos/modelos personalizados em Workflows usando uma API de streaming.

- O Gapi Server pode rodar em qualquer Jetson Orin ou, na verdade, em qualquer computador, pois os Microsserviços se conectam para fora por meio de web sockets seguros. Ele não usa nenhum recurso de GPU. Há também uma pequena versão de demonstração para pular a instalação do Server (mas você ainda precisará executar seus próprios Microsserviços).

- Página do Projeto Gapi

- Gapi Github

- Documentação do Gapi

- Demo Hospedada do Gapi

Requisitos

- Qualquer NVIDIA Jetson Orin

- Docker

- Espaço de Armazenamento Suficiente: 1,3 GB

Instalar o Gapi no Jetson

Execute estas etapas para instalar o Gapi no Jetson:

mkdir ~/gapiData && cd ~/gapiData

curl -L https://raw.githubusercontent.com/genai-nerds/Gapi/main/gapiConfigs.zip -o gapiConfigs.zip

unzip -q gapiConfigs.zip

docker run -d --name gapi --network host -v ~/gapiData:/opt/gapi/vdata genainerds/gapi:arm64 /bin/bash -c "cd /opt/gapi/bin && ./startGapi.sh"

echo "You may need to hit Enter now. Afterwards the Docker container 'gapi' s

Fazer Login

- Acesse em: http://[host-device-ip]:8090

- Usuário: root

- Senha: !gapi2024

- Altere a senha em Settings! A documentação mostra como adicionar certificado SSL.

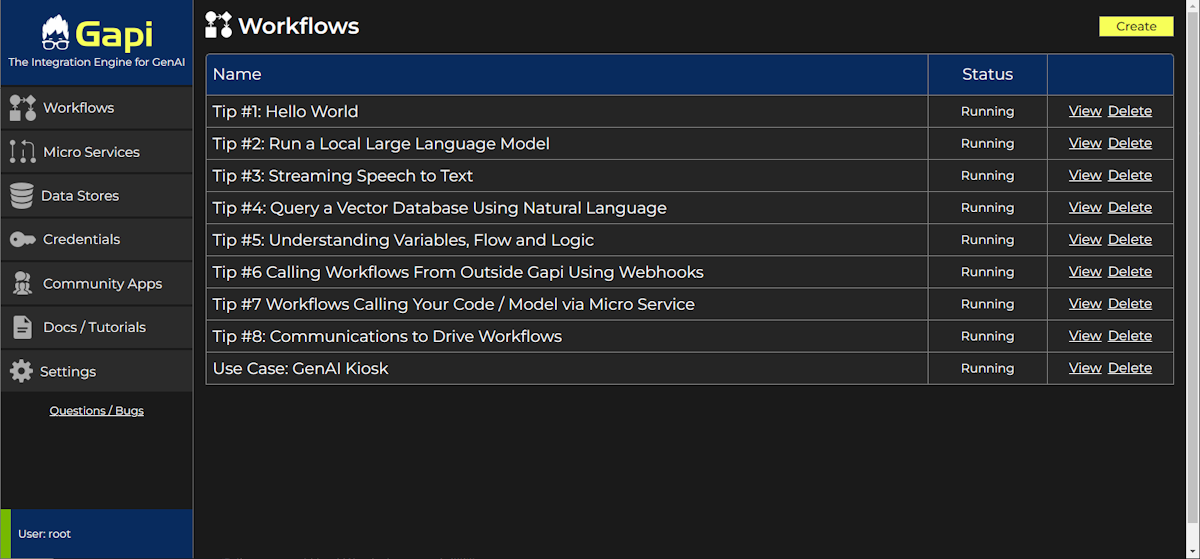

Workflows

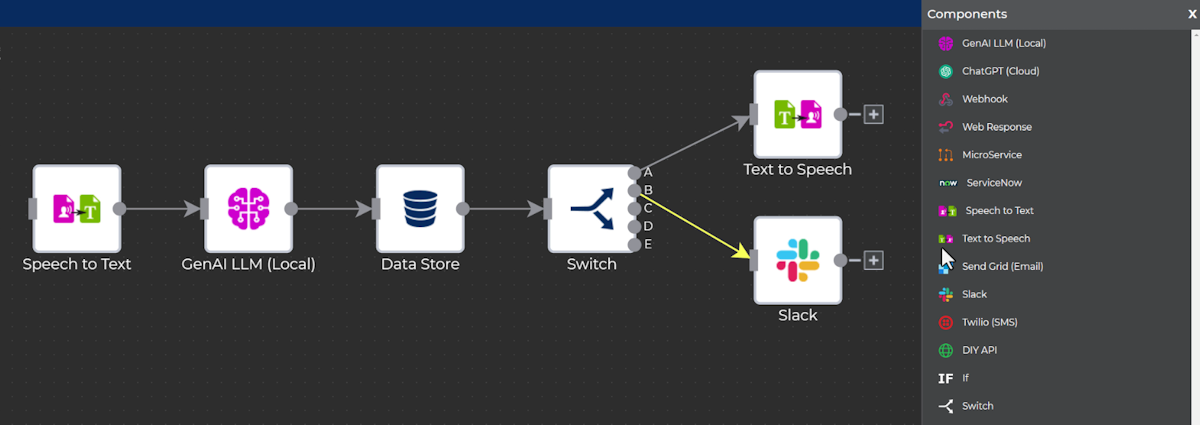

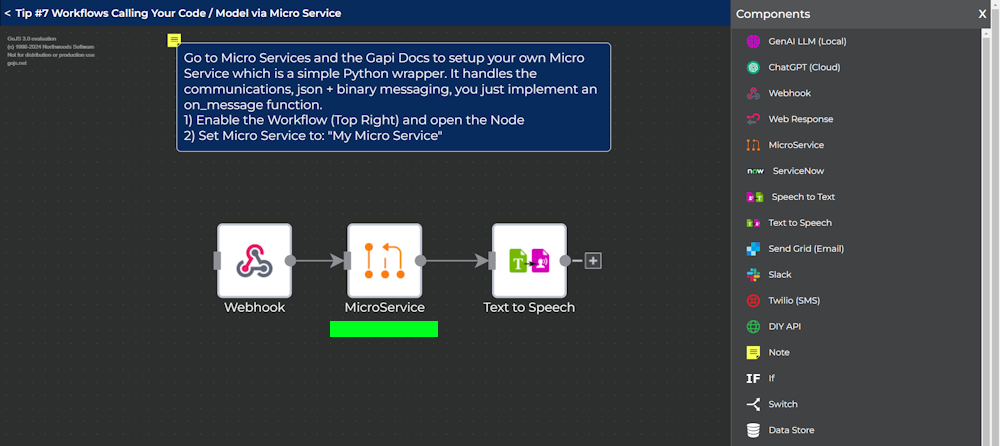

Os Workflows conectam visualmente a execução e o fluxo de dados entre os Nós.

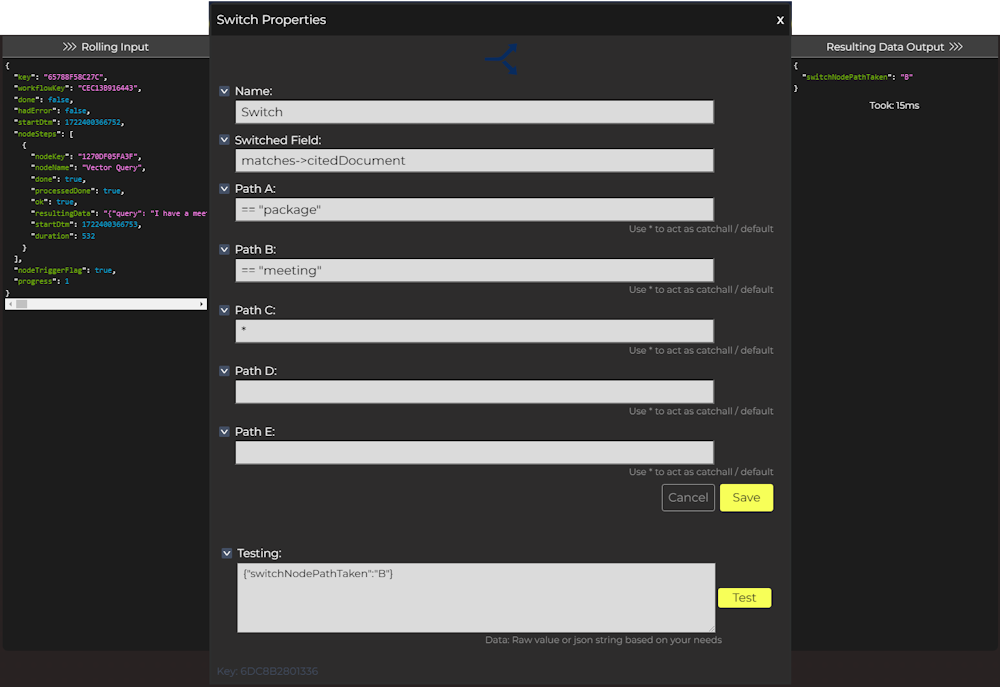

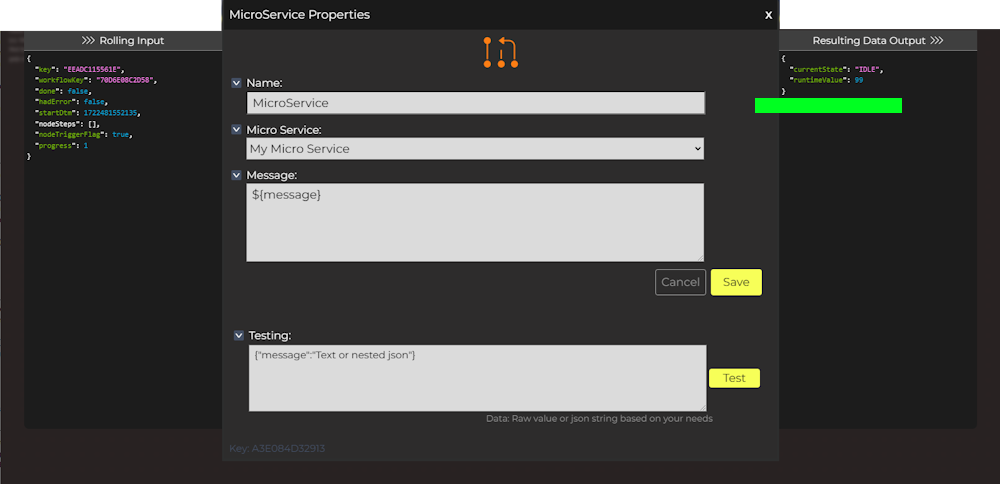

Uma Transação (ou disparo único) possui dados de "Rolling Input" que acumula conforme as etapas de Nó para Nó se comunicam com Microsserviços e APIs. Todos os Nós aproveitam variáveis e controle de fluxo usando conceitos familiares de json e javascript.

Cada Nó pode anexar ou referenciar os dados em andamento na Transação enquanto toma decisões ao longo do caminho.

Veja as Transações ao vivo enquanto elas se iniciam a partir de clientes, webhooks e mensagens publicadas por Microsserviços, com feedback visual e depuração.

Microsserviços

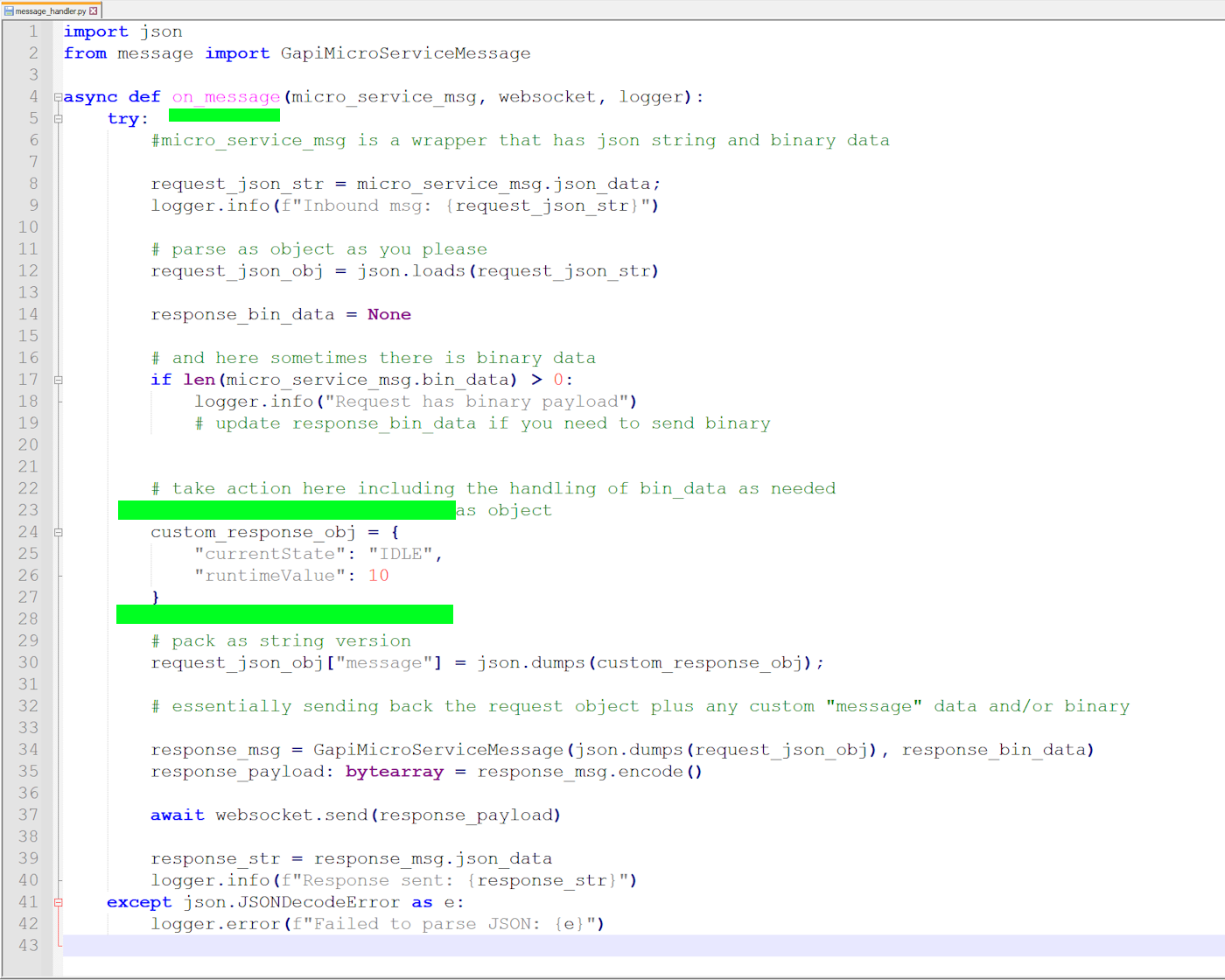

Um Microsserviço é um processo que executa um script wrapper em python que integra seus códigos/modelos personalizados para que possam ser integrados aos Workflows do Gapi.

Você pode executar um Microsserviço onde quiser e conectá-lo a um Gapi Server por meio do protocolo de mensagens de streaming híbrido binário+json.

Existem alguns “Microsserviços da Comunidade" prontos para uso que nós integramos, testamos e empacotamos em imagens Docker. Quando você os executa, eles se integram automaticamente, carregam as camadas NVIDIA corretamente e oferecem logging para o sistema host.

Ainda melhor, crie o seu próprio! Basta implementar um handler on_message em Python para processar solicitações e responder. O restante é tratado para você.

Pense em um Microsserviço como um simples wrapper para algum código ou modelo que você tenha. Ele funciona da mesma forma que qualquer outro Nó dentro de um Workflow. Quando chega a vez do seu Nó de Microsserviço, sua função on_message será chamada. Seu script recebe os dados em andamento da Transação para contexto e então você publica seus dados diretamente de volta no fluxo.

Executando os Microsserviços da Comunidade

Requisitos para Microsserviços da Comunidade

- Qualquer NVIDIA Jetson Orin

- Espaço de Armazenamento Suficiente:

- Literalmente 4 KB para o seu próprio Microsserviço

- De cerca de ~4 GB a ~10 GB para cada Microsserviço da Comunidade

Etapas:

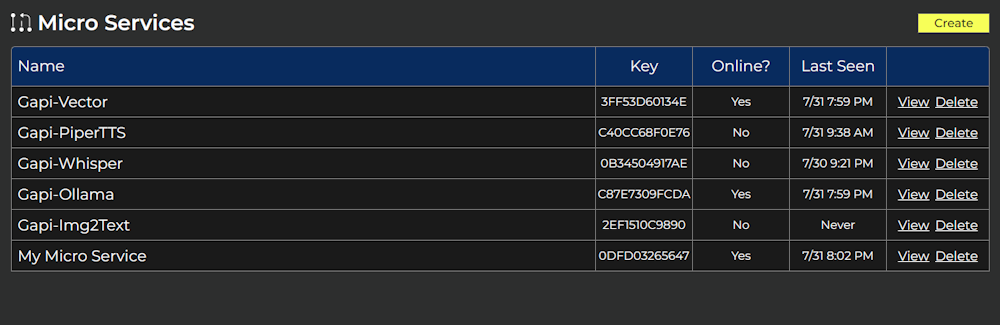

- Faça login e vá até a aba Micro Services

- Siga as instruções na caixa azul nessa página para baixar sua configuração personalizada

- Em seguida, siga as instruções abaixo disso para instalar o Microsserviço desejado

Parabéns! Agora você pode seguir as Dicas de Workflow

Suporte Técnico & Discussão de Produto

Obrigado por escolher nossos produtos! Estamos aqui para oferecer diferentes tipos de suporte para garantir que sua experiência com nossos produtos seja a mais tranquila possível. Oferecemos vários canais de comunicação para atender a diferentes preferências e necessidades.