Implemente um LLM de voz local no reComputer Mini para o Reachy Mini!

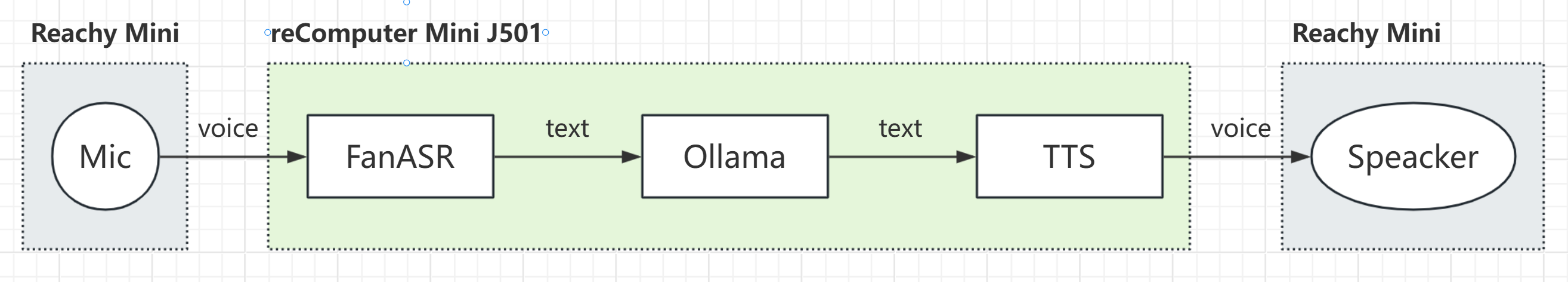

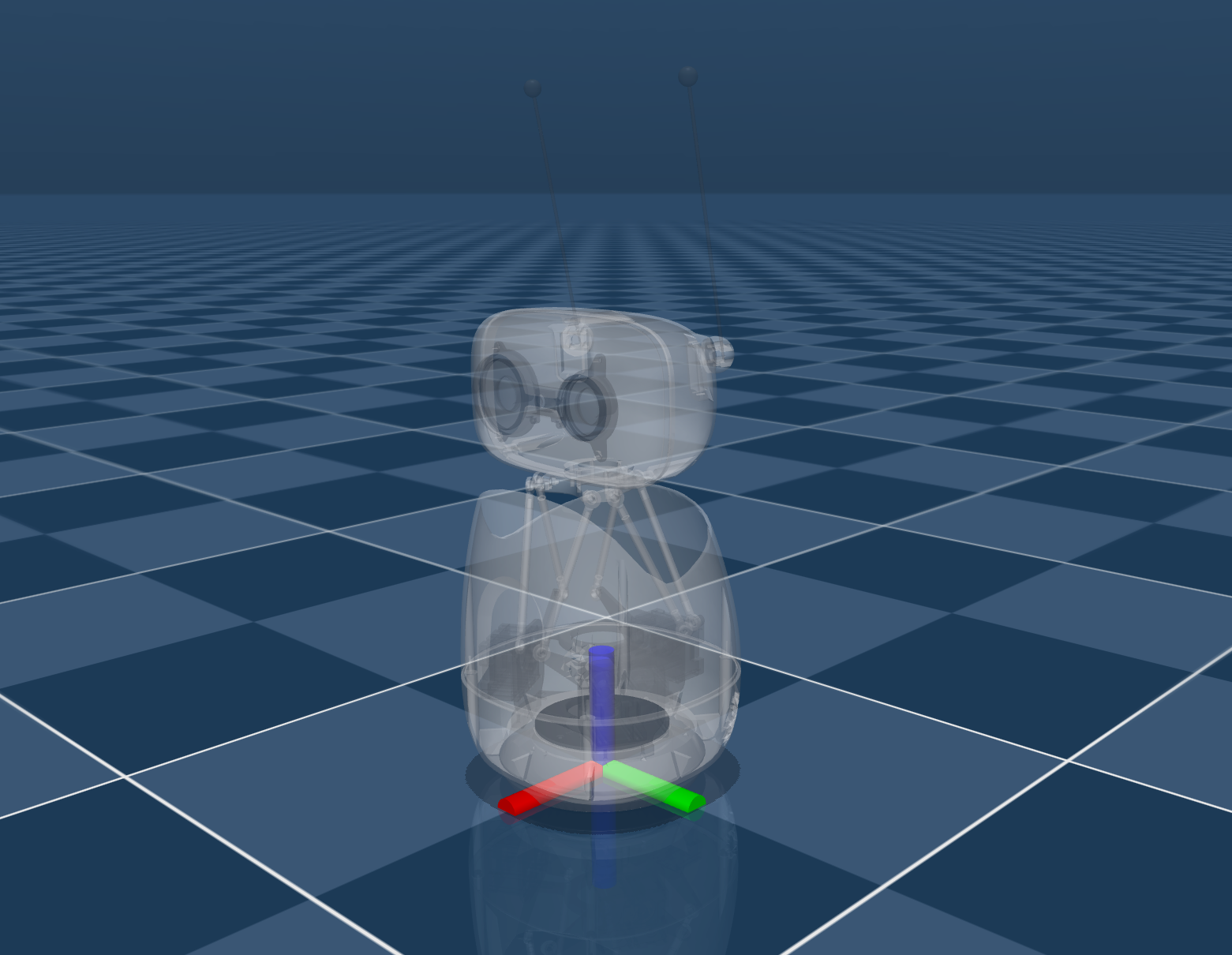

Double Mini! Este projeto irá construir um sistema de assistente robótico interativo por voz totalmente local, de baixa latência e alta privacidade. Centralizado no dispositivo de computação de borda reComputer Mini J501, ele implanta serviços locais de reconhecimento de fala, modelo de linguagem grande e síntese de fala. Usando a plataforma robótica de código aberto Reachy Mini como terminal físico para interação humano-computador, ele alcança uma experiência de interação inteligente incorporada que é perceptiva, conversacional e acionável.

Pré-requisitos

- Kit reComputer Mini J501

- Reachy Mini Lite

| Kit reComputer Mini J501 | Reachy Mini Lite |

|---|---|

|  |

Certifique-se de que o seu dispositivo Jetson inclua a carrier board, o módulo Jetson e o sistema de resfriamento, e que o sistema operacional JP6.2 esteja instalado.

Antes de configurar o software, conecte o Reachy Mini à porta Type-A do reComputer Mini J501.

Implantar aplicativos de software

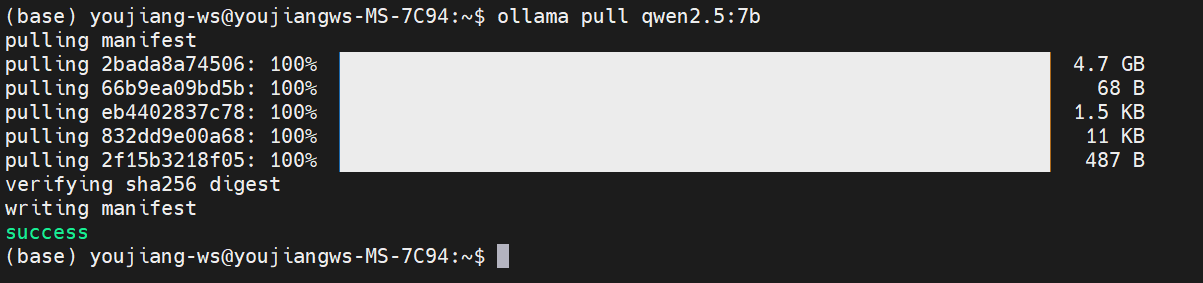

Passo 1. Instale e execute o servidor de inferência ollama no reComputer Jetson.

Execute o seguinte comando na janela do terminal (Ctrl + Alt + T) no reComputer Jetson.

# Install Ollama (visit https://ollama.ai for platform-specific instructions)

curl -fsSL https://ollama.com/install.sh | sh

# Pull the required model

ollama pull llama3.2-vision:11b

O download do modelo levará aproximadamente 10 minutos. Aguarde com paciência.

Passo 2. Instale o aplicativo de conversação.

Execute o seguinte comando na janela do terminal no reComputer Jetson.

Se você quiser configurar o ambiente de execução em um ambiente virtual conda, use o comando conda activate <name> para ativar o ambiente de destino antes de executar os comandos de instalação a seguir.

cd Downloads

git clone https://github.com/Seeed-Projects/reachy-mini-loacl-conversation.git

cd reachy-mini-loacl-conversation

pip install -r requirements.txt -i https://pypi.jetson-ai-lab.io/

pip install "reachy-mini"

Consulte aqui para obter mais informações de instalação.

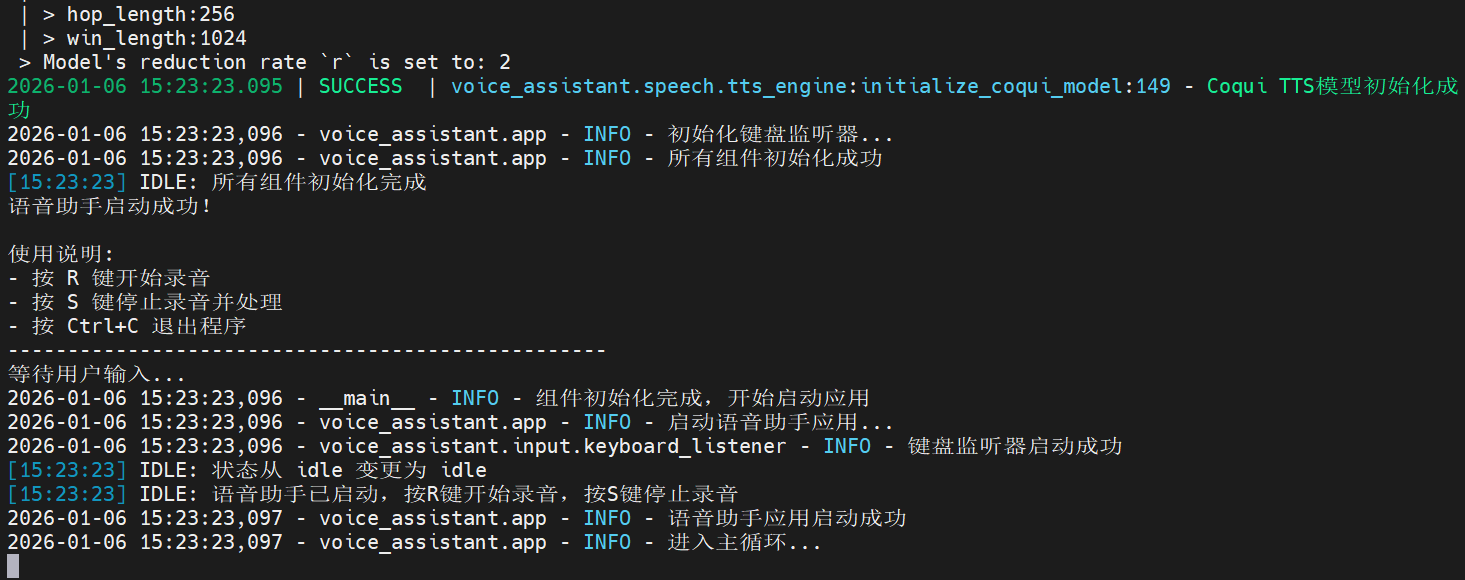

Passo 3. Inicie o aplicativo.

Execute o seguinte comando na janela do terminal no reComputer Jetson para iniciar o daemon do reachy mini.

reachy-mini-daemon

Abra outro terminal e execute:

# Set environment variables

export OLLAMA_HOST="http://localhost:11434"

export OLLAMA_MODEL="qwen2.5:7b"

export COQUI_MODEL_NAME="tts_models/zh-CN/baker/tacotron2-DDC-GST"

export DEFAULT_VOLUME="1.5"

# Start the voice assistant

python main.py

Aqui, um modelo em chinês é usado para a demonstração. Você pode substituí-lo por modelos em outros idiomas de acordo com suas necessidades.

Demonstração do efeito

Após o programa iniciar normalmente, podemos usar as teclas R e S no teclado para controlar o início e o término da gravação. Quando a gravação for encerrada, o programa chamará o modelo de linguagem grande local para gerar uma resposta.

Referências

- https://ollama.com/download/linux

- https://github.com/modelscope/FunASR

- https://github.com/coqui-ai/TTS

- https://github.com/Seeed-Projects/reachy-mini-loacl-conversation/

Suporte Técnico & Discussão de Produto

Obrigado por escolher nossos produtos! Estamos aqui para fornecer diferentes tipos de suporte para garantir que sua experiência com nossos produtos seja a mais tranquila possível. Oferecemos vários canais de comunicação para atender a diferentes preferências e necessidades.